«`html

Как Consistency Large Language Models (CLLMs) могут улучшить ваш бизнес с помощью искусственного интеллекта (ИИ)

Большие языковые модели (LLMs), включая GPT-4, LLaMA и PaLM, расширяют границы искусственного интеллекта. Однако, инферентная задержка LLM играет важную роль из-за интеграции LLM в различные приложения, обеспечивая положительный пользовательский опыт и высокое качество обслуживания.

Эффективный метод вывода LLM

Метод вывода LLM разделяется на два потока: один требует дополнительного обучения, а другой — нет. Исследователи изучили этот метод из-за высокой стоимости вывода LLM, сосредоточившись в основном на увеличении процесса декодирования AR. Еще один существующий метод — LLM Distillation, где используется техника Knowledge distillation (KD) для создания небольших моделей и замены функциональности более крупных.

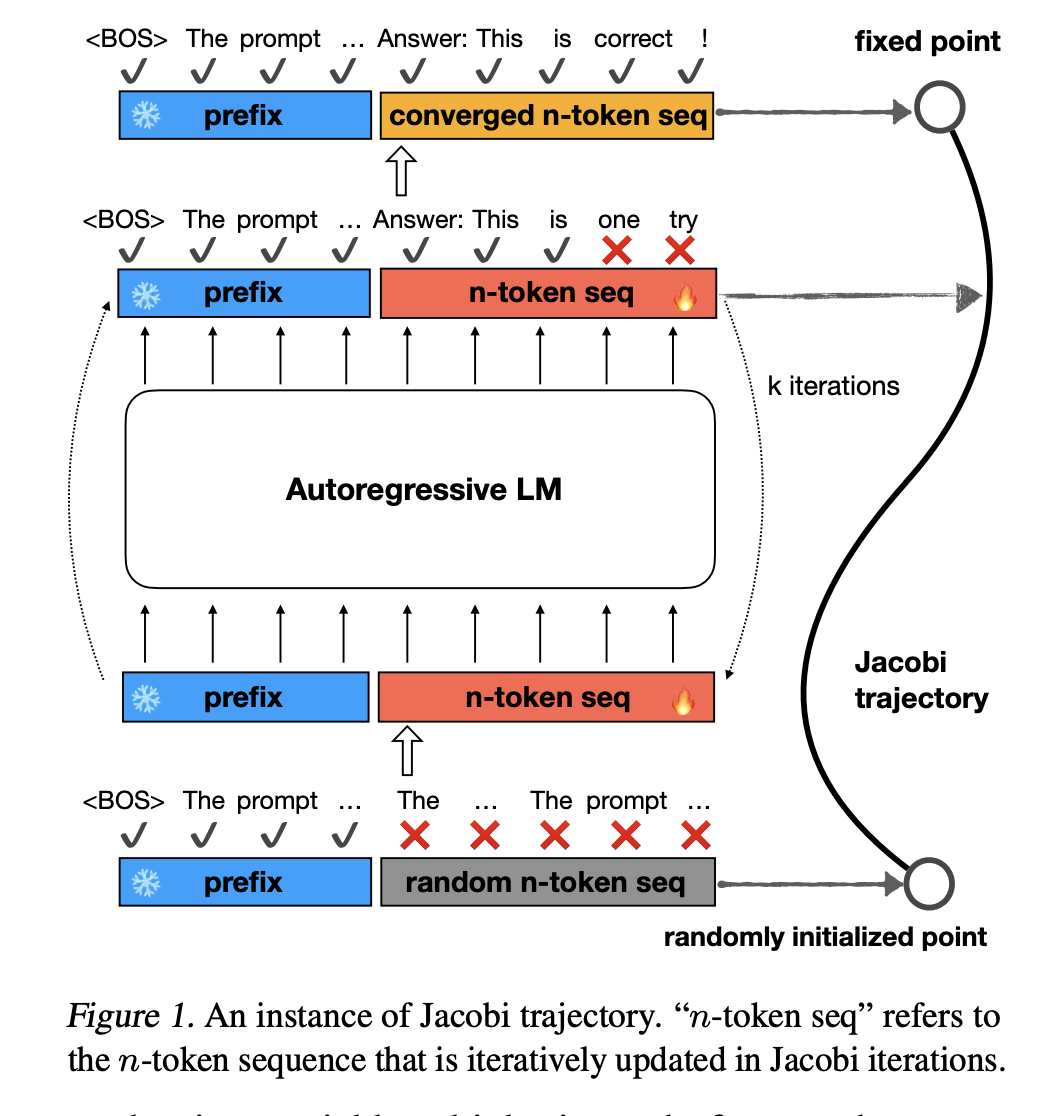

Consistency Large Language Models (CLLMs)

Исследователи из университетов Шанхая и Калифорнии предложили CLLMs, новое семейство LLMs, специализированное для метода декодирования Якоби для снижения задержки. CLLM был сравнен с традиционными методами, такими как спекулятивное декодирование и Медуза, и не требует дополнительной памяти для этой задачи, в отличие от других методов.

Преимущества CLLMs

CLLMs показывают выдающуюся производительность на различных бенчмарках, например, они могут достичь ускорения в 2,4× до 3,4× с использованием декодирования Якоби с практически отсутствием потерь в точности на специализированных бенчмарках, таких как GSM8K, CodeSearchNet Python и Spider.

Заключение

CLLMs — новое семейство LLMs, которые отличаются эффективным параллельным декодированием и разработаны таким образом, чтобы улучшить эффективность декодирования Якоби. Это помогает уменьшить сложность архитектуры и управления двумя различными моделями в одной системе.

Подробнее о исследовании и проекте.

Все права на это исследование принадлежат его авторам.

Также не забудьте подписаться на наш Twitter.

Присоединяйтесь к нашему каналу в Telegram, Discord и группе в LinkedIn.

Если вам понравилась наша работа, вам понравится и наша рассылка.

Не забудьте присоединиться к нашему SubReddit.

Если вам нужны советы по внедрению ИИ, пишите нам на Telegram.

Следите за новостями о ИИ в нашем Телеграм-канале itinainews или в Twitter.

Попробуйте AI Sales Bot. Этот AI ассистент в продажах помогает отвечать на вопросы клиентов, генерировать контент для отдела продаж и снижать нагрузку на первую линию.

Узнайте, как ИИ может изменить ваши процессы с решениями от AI Lab itinai.ru. Будущее уже здесь!

«`

за 6 месяцев.

А что бы вы сделали с этими деньгами?

за 6 месяцев.

А что бы вы сделали с этими деньгами? за 3 месяца. Какие процессы в вашем бизнесе скинуть роботу?

за 3 месяца. Какие процессы в вашем бизнесе скинуть роботу?  . Как это работает?

. Как это работает?  . Расскажите подробнее!

. Расскажите подробнее!