Новый метод LLM2LLM от исследователей из Университета Калифорнии в Беркли, ICSI и Лаборатории Лоуренса Беркли (LBNL) открывает новые возможности для улучшения производительности больших языковых моделей в условиях ограниченных данных с использованием синтетических данных.

Методология LLM2LLM

LLM2LLM представляет собой инновационный метод, предназначенный для усиления возможностей LLM в условиях ограниченных данных. В отличие от традиционных методов аугментации данных, LLM2LLM использует итеративный процесс, который направлен на устранение недостатков модели, последовательно улучшая ее производительность.

Методология включает в себя взаимодействие двух LLM: учителя и студента. Модель студента подвергается тонкой настройке на ограниченном наборе данных и оценивается для выявления случаев, когда она неспособна точно предсказать. Затем модель учителя генерирует новые синтетические данные для повторного обучения модели студента, фокусируясь на преодолении ранее выявленных недостатков.

Тестирование на различных наборах данных продемонстрировало замечательное улучшение производительности модели, с наблюдаемым повышением до 32,6%.

Практические решения в области искусственного интеллекта

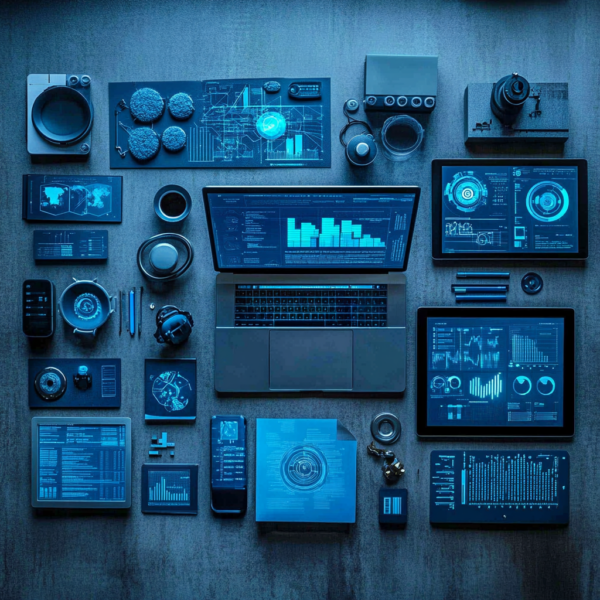

Для компаний, желающих использовать возможности искусственного интеллекта, важно идентифицировать возможности для автоматизации, определить ключевые показатели эффективности, выбрать подходящие решения на базе искусственного интеллекта и постепенно их внедрять. Наш AI Sales Bot — это практическое решение, созданное для автоматизации взаимодействия с клиентами и управления взаимодействиями на всех этапах пути клиента.

Для получения дополнительной информации о возможностях использования искусственного интеллекта и изучения наших решений посетите itinai.com/aisalesbot.