Ускорение вывода больших языковых моделей с Mistral.rs

Проблемой, замедляющей применение больших языковых моделей (LLMs) в реальных приложениях, является низкая скорость вывода. Модели LLM требуют значительных вычислительных ресурсов для генерации результатов, что может отрицательно сказываться на пользовательском опыте, увеличивать операционные затраты и ограничивать практическое использование во временно чувствительных сценариях.

Оптимизация скорости вывода LLM

Существующие методы ускорения вывода LLM включают ускорение аппаратного обеспечения, оптимизацию модели и методы квантования, каждый из которых направлен на снижение вычислительной нагрузки при выполнении этих моделей. Однако эти методы включают компромиссы между скоростью, точностью и удобством использования. Например, квантование снижает размер модели и время вывода, но может ухудшить точность прогнозов модели. Также, ускорение аппаратного обеспечения (например, с использованием GPU или специализированных чипов) способно улучшить производительность, но требует доступа к дорогим аппаратным средствам, что ограничивает его доступность.

Преимущества платформы Mistral.rs

Платформа Mistral.rs предлагает быструю, универсальную и удобную платформу для вывода LLM. Она поддерживает широкий спектр устройств и включает передовые методы квантования для эффективного балансирования скорости и точности. Также Mistral.rs упрощает процесс развертывания с помощью простого API и обширной поддержки моделей, что делает ее доступной для более широкого круга пользователей и сфер применения.

Платформа Mistral.rs использует несколько ключевых технологий и оптимизаций для достижения высокой производительности. Она использует методы квантования, такие как GGML и GPTQ, которые позволяют сжимать модели в более эффективные представления без значительной потери точности. Также Mistral.rs поддерживает различные аппаратные платформы, включая Apple silicon, ЦП и GPU, с использованием оптимизированных библиотек, таких как Metal и CUDA, для максимизации производительности.

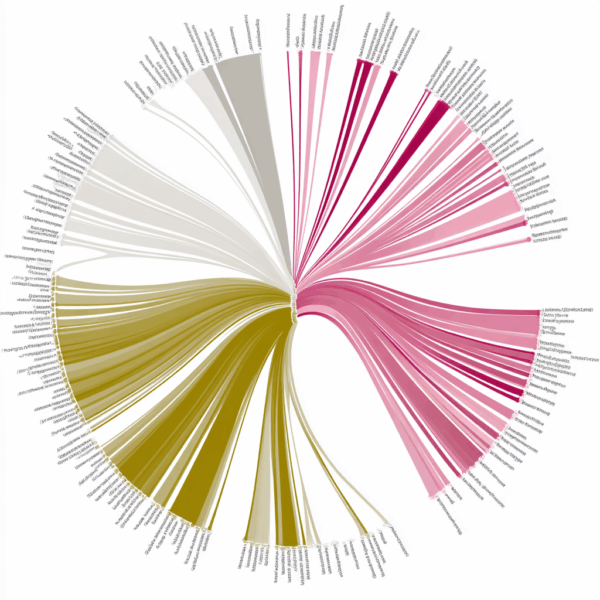

Кроме того, платформа включает функции, такие как непрерывное пакетирование, оптимизирующее обработку нескольких запросов одновременно, и PagedAttention, оптимизирующее использование памяти во время вывода. Эти функции позволяют Mistral.rs эффективно обрабатывать большие модели и наборы данных, уменьшая вероятность ошибок из-за нехватки памяти.

В заключение, Mistral.rs решает проблему медленного вывода LLM, предлагая универсальную и высокопроизводительную платформу, которая учитывает скорость, точность и удобство использования. Ее поддержка широкого спектра устройств и передовые оптимизационные методы делают ее ценным инструментом для разработчиков, стремящихся развернуть LLM в реальных приложениях, где производительность и эффективность играют ключевую роль.

Преимущества использования ИИ-решений в бизнесе

Если вы планируете использовать искусственный интеллект для улучшения вашего бизнеса, Mistral.rs представляет собой мощное и практичное решение для ускорения вывода больших языковых моделей. Платформа обеспечивает значительное сокращение времени вывода, что способствует повышению производительности и сокращению операционных затрат.

Практическое применение ИИ в бизнесе

Рассмотрите возможности автоматизации и определите, где ваш бизнес может получить выгоду от использования ИИ. Выявите ключевые показатели эффективности, которые вы хотели бы улучшить с помощью ИИ. Постепенно внедряйте ИИ-решения, начиная с маленьких проектов и анализируя их результаты.

Если вам нужны советы по внедрению ИИ в бизнес, обратитесь к нам на https://t.me/itinai. Следите за новостями о ИИ в нашем Телеграм-канале t.me/itinainews или в Twitter @itinairu45358.

Используйте AI Sales Bot itinai.ru/aisales для автоматизации процессов в области продаж. Этот AI ассистент помогает обрабатывать вопросы клиентов, генерировать контент и снижать нагрузку на персонал.

Узнайте, как решения AI Lab itinai.ru могут изменить ваши бизнес-процессы. Будущее уже здесь!