«`html

Решение OneGen: единая платформа для обработки поиска и генерации текста

Одной из ключевых проблем в развертывании масштабных моделей обработки языка (LLM) является неспособность эффективно управлять задачами, которые требуют как генерации, так и поиска информации. Модели LLM отлично генерируют связный и контекстуально значимый текст, но испытывают трудности с поиском необходимой информации перед формированием ответа. Это особенно заметно при выполнении задач, таких как вопросно-ответная система, многопрыжковое рассуждение и связывание сущностей, где быстрый и точный поиск необходим для генерации осмысленных результатов.

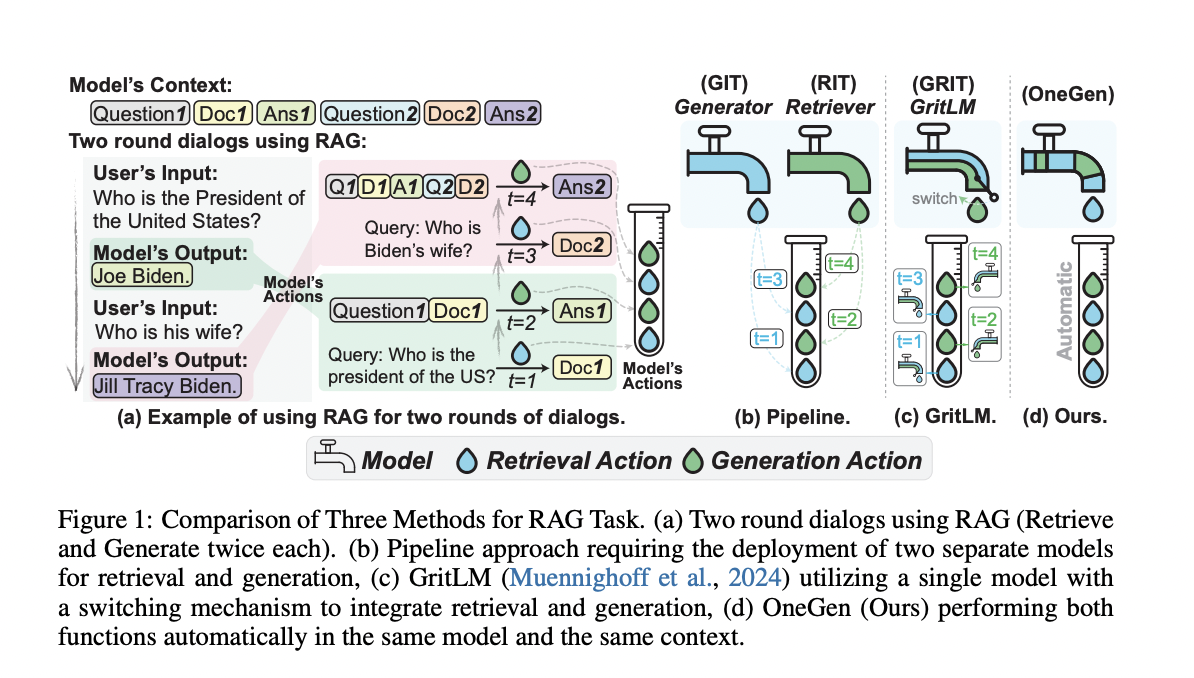

Ранее предложенные методы, такие как Retrieval-Augmented Generation (RAG), пытались интегрировать поиск в процесс генерации, извлекая необходимые данные и передавая их в отдельную модель для генерации. Однако такой подход вносит существенные ограничения, требуя отдельных моделей для поиска и генерации, что увеличивает вычислительную сложность и приводит к неэффективности. OneGen предлагает новое решение, объединяющее процессы поиска и генерации в один проход в модели LLM. Путем интеграции авторегрессионных поисковых токенов в модель, OneGen позволяет системе выполнять обе задачи одновременно без необходимости использования нескольких проходов вперед или отдельных моделей для поиска и генерации. Этот инновационный подход значительно снижает вычислительную сложность и время вывода, улучшая эффективность моделей LLM.

Практическое применение и ценность

OneGen демонстрирует превосходное качество в различных задачах, требующих как поиска, так и генерации информации, сравнительно с имеющимися моделями, такими как Self-RAG и GRIT. Он показал значительное улучшение точности и показателей F1, особенно в многопрыжковых вопросно-ответных задачах и связывании сущностей. Кроме того, он сохраняет эффективность в поисковых задачах, улучшая генеративные способности модели. Эти результаты подчеркивают способность OneGen ускорить и улучшить точность процесса поиска и генерации, не жертвуя качеством выполнения ни одной из задач.

В заключение, OneGen представляет собой эффективное решение для интеграции поиска и генерации в рамках LLM. Этот объединенный подход улучшает скорость и точность моделей LLM в задачах, требующих реального времени генерации на основе извлеченной информации. С продемонстрированными улучшениями производительности по нескольким бенчмаркам, OneGen имеет потенциал изменить подход к решению сложных задач, включающих одновременно поиск и генерацию, делая их более применимыми в реальных, быстрых и точных приложениях.

Подробнее с документацией ознакомьтесь на GitHub.

Автор: AI Lab itinai.ru

«`