«`html

Руководство по выбору индексов HNSW, Flat и Inverted для вашего поиска

Сегодня одной из значительных проблем в поиске информации является определение наиболее эффективного метода поиска ближайших векторов, особенно с увеличением сложности моделей плотного и разреженного поиска. Практики должны выбирать между различными методами индексации и поиска, включая графы HNSW (Hierarchical Navigable Small-World), плоские индексы и инвертированные индексы. Эти методы предлагают различные компромиссы в скорости, масштабируемости и качестве результатов поиска. С увеличением размеров наборов данных и их сложности отсутствие четкого операционного руководства затрудняет оптимизацию систем, особенно для приложений, требующих высокой производительности, таких как поисковые системы и приложения на основе искусственного интеллекта, например, системы вопросов и ответов.

Традиционные подходы к поиску ближайших соседей

Традиционно поиск ближайших соседей осуществляется с использованием трех основных подходов: индексы HNSW, плоские индексы и инвертированные индексы. Индексы HNSW часто используются из-за их эффективности и скорости в задачах поиска в большом масштабе, особенно с плотными векторами, но они требуют значительных вычислительных ресурсов и времени индексации. Плоские индексы, хотя точны в результатах поиска, становятся непрактичными для больших наборов данных из-за медленной производительности запросов. Разреженные модели поиска, такие как BM25 или SPLADE++ ED, используют инвертированные индексы и могут быть эффективны в конкретных сценариях, но часто лишены богатого семантического понимания, предоставляемого моделями плотного поиска. Основным ограничением всех этих подходов является то, что ни один из них не является универсально применимым, поскольку каждый метод имеет свои сильные и слабые стороны в зависимости от размера набора данных и требований к поиску.

Исследование и рекомендации

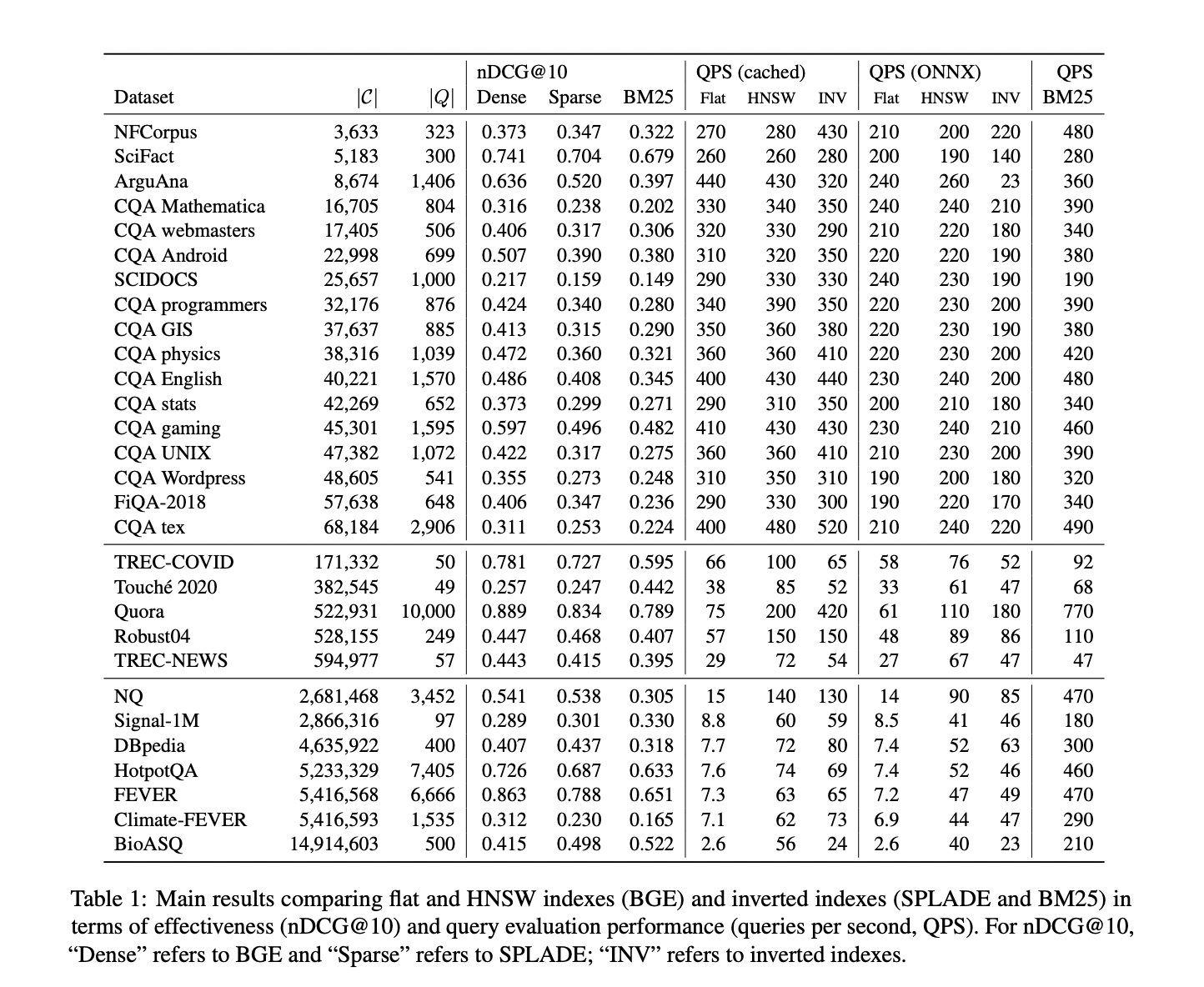

Исследователи из Университета Ватерлоо представляют тщательную оценку компромиссов между индексами HNSW, плоскими и инвертированными индексами как для моделей плотного, так и для разреженного поиска. Это исследование предоставляет подробный анализ производительности этих методов, измеренной по времени индексации, скорости запросов (QPS) и качеству поиска (nDCG@10), используя набор данных BEIR в качестве эталона. Исследователи стремятся дать практические, основанные на данных советы по оптимальному использованию каждого метода в зависимости от размера набора данных и требований к поиску. Их результаты показывают, что HNSW чрезвычайно эффективен для наборов данных большого масштаба, в то время как плоские индексы лучше всего подходят для небольших наборов данных из-за своей простоты и точности. Кроме того, исследование исследует преимущества использования техник квантования для улучшения масштабируемости и скорости процесса поиска, предлагая значительное улучшение для практиков, работающих с большими наборами данных.

Экспериментальная установка использует набор данных BEIR, включающий 29 наборов данных, разработанных для отражения реальных вызовов поиска информации. В качестве модели плотного поиска используется BGE (Base General Embeddings), а в качестве эталонов для разреженного поиска — SPLADE++ ED и BM25. Оценка фокусируется на двух типах индексов плотного поиска: HNSW, который строит графовые структуры для поиска ближайших соседей, и плоские индексы, которые полагаются на полный перебор. Инвертированные индексы используются для разреженных моделей поиска. Оценка проводится с использованием библиотеки поиска Lucene, с конкретными конфигурациями, такими как M=16 для HNSW. Производительность оценивается с использованием ключевых метрик, таких как nDCG@10 и QPS, а производительность запросов оценивается в двух условиях: кешированные запросы (предварительно вычисленное кодирование запроса) и кодирование запросов в реальном времени на основе ONNX.

Результаты показывают, что для небольших наборов данных (менее 100 тыс. документов) плоские и HNSW индексы демонстрируют сопоставимую производительность как по скорости запросов, так и по качеству поиска. Однако с увеличением размеров наборов данных индексы HNSW начинают значительно превосходить плоские индексы, особенно по скорости оценки запросов. Для больших наборов данных, превышающих 1 миллион документов, индексы HNSW обеспечивают гораздо большее количество запросов в секунду (QPS) при незначительном снижении качества поиска (nDCG@10). При работе с наборами данных более 15 миллионов документов индексы HNSW демонстрируют существенное улучшение скорости при приемлемой точности поиска. Техники квантования дополнительно улучшают производительность, особенно в больших наборах данных, обеспечивая значительное увеличение скорости запросов без существенного снижения качества. В целом модели плотного поиска с использованием индексов HNSW оказываются гораздо более эффективными и эффективными, чем разреженные модели поиска, особенно для приложений большого масштаба, требующих высокой производительности.

Это исследование предлагает важные рекомендации для практиков в области плотного и разреженного поиска, предоставляя всестороннюю оценку компромиссов между индексами HNSW, плоскими и инвертированными индексами. Результаты показывают, что индексы HNSW отлично подходят для задач поиска большого масштаба из-за их эффективности в обработке запросов, в то время как плоские индексы идеально подходят для небольших наборов данных и быстрого прототипирования из-за своей простоты и точности. Предоставляя рекомендации, подкрепленные эмпирическими данными, это исследование значительно способствует пониманию и оптимизации современных систем поиска информации, помогая практикам принимать обоснованные решения для поисковых приложений на основе искусственного интеллекта.

Проверьте статью. Вся заслуга за это исследование принадлежит исследователям этого проекта. Также не забудьте подписаться на нас в Twitter и присоединиться к нашему каналу в Telegram и группе в LinkedIn. Если вам нравится наша работа, вам понравится наш новостной бюллетень.

Не забудьте присоединиться к нашему сообществу более чем 50 тыс. специалистов по машинному обучению на ML SubReddit.

БЕСПЛАТНЫЙ ВЕБИНАР ПО ИСКУССТВЕННОМУ ИНТЕЛЛЕКТУ: «SAM 2 для видео: Как настроить под ваши данные» (Ср, 25 сентября, 4:00 — 4:45 EST)

Статья HNSW, Flat, or Inverted Index: Which Should You Choose for Your Search? This AI Paper Offers Operational Advice for Dense and Sparse Retrievers впервые появилась на MarkTechPost.

«`