«`html

Решение проблемы вычислительной неэффективности в AI

Актуальные методы и новаторские решения

Одной из значительных проблем в исследованиях по искусственному интеллекту (AI) является неэффективность вычислений при обработке визуальных токенов в моделях Vision Transformer (ViT) и Video Vision Transformer (ViViT). Эти модели обрабатывают все токены с одинаковым упорством, игнорируя врожденную избыточность визуальных данных, что приводит к высоким вычислительным издержкам.

Проблема эффективной обработки визуальных токенов в AI решена с помощью нового метода — Mixture of Nested Experts (MoNE).

Эффективное повышение производительности AI

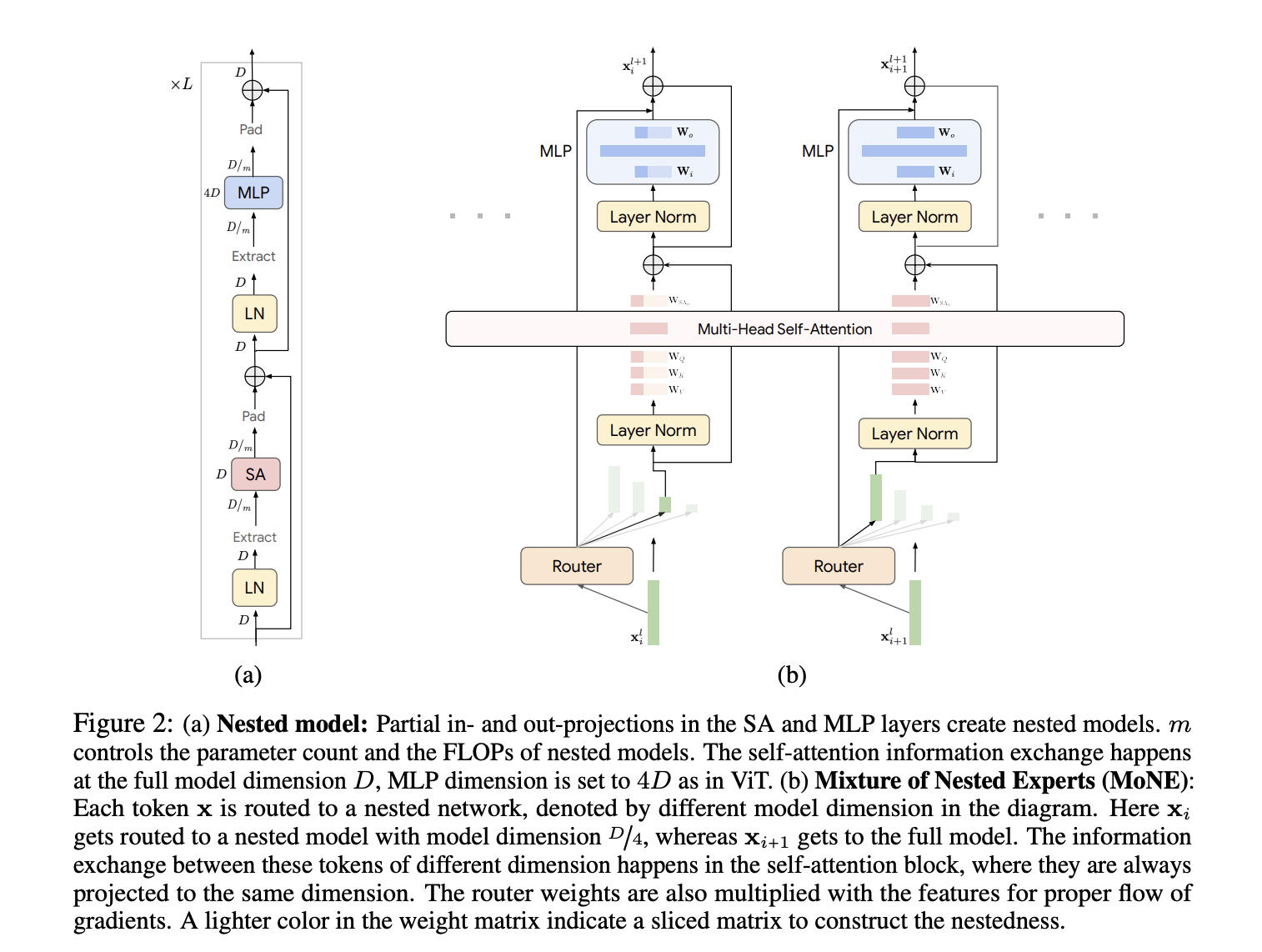

MoNE динамически выделяет вычислительные ресурсы, направляя токены к различным вложенным экспертам на основе их важности. Этот подход позволяет обрабатывать избыточные токены через более маленькие, дешевые модели, в то время как более важные токены направляются к более крупным, более детальным моделям. Использование вложенной архитектуры позволяет обеспечить удвоенное сокращение вычислений в реальном времени.

Благодаря высокой эффективности и сохранению производительности при различных бюджетах, MoNE улучшает обработку изображений и видео.

Доказанная эффективность и практические результаты

MoNE показывает значительное улучшение вычислительной эффективности и производительности на различных наборах данных. Например, на ImageNet-21K MoNE достигает точности 87,5%, что является существенным улучшением по сравнению с базовыми моделями. В задачах классификации видео на наборах данных Kinetics400 и Something-Something-v2 MoNE демонстрирует сокращение вычислительных затрат в два-три раза, сохраняя или превышая точность традиционных методов. Адаптивные возможности MoNE позволяют ему поддерживать стабильное качество даже при ограниченных вычислительных бюджетах.

MoNE предлагает существенное развитие в области эффективной обработки визуальных токенов, обеспечивая значительное сокращение вычислительных затрат без ущерба для производительности.

«`