Революция в области ИИ: улучшение работы больших языковых моделей

Проблема:

Большие языковые модели (LLMs) способны генерировать текст, но испытывают затруднения с задачами, требующими специфических знаний, например, в здравоохранении, праве и финансах.

Решение:

Улучшение LLMs с использованием внешних данных позволяет им стать более точными и эффективными, повышая качество работы. Техника Retrieval-Augmented Generation (RAG) позволяет моделям получать необходимую информацию в реальном времени.

Выгода:

Использование подходов, таких как fine-tuning и RAG, помогает моделям лучше справляться с задачами, требующими специализированных знаний. Это улучшает точность и актуальность ответов, снижает вероятность ошибок и улучшает производительность.

Пример успеха:

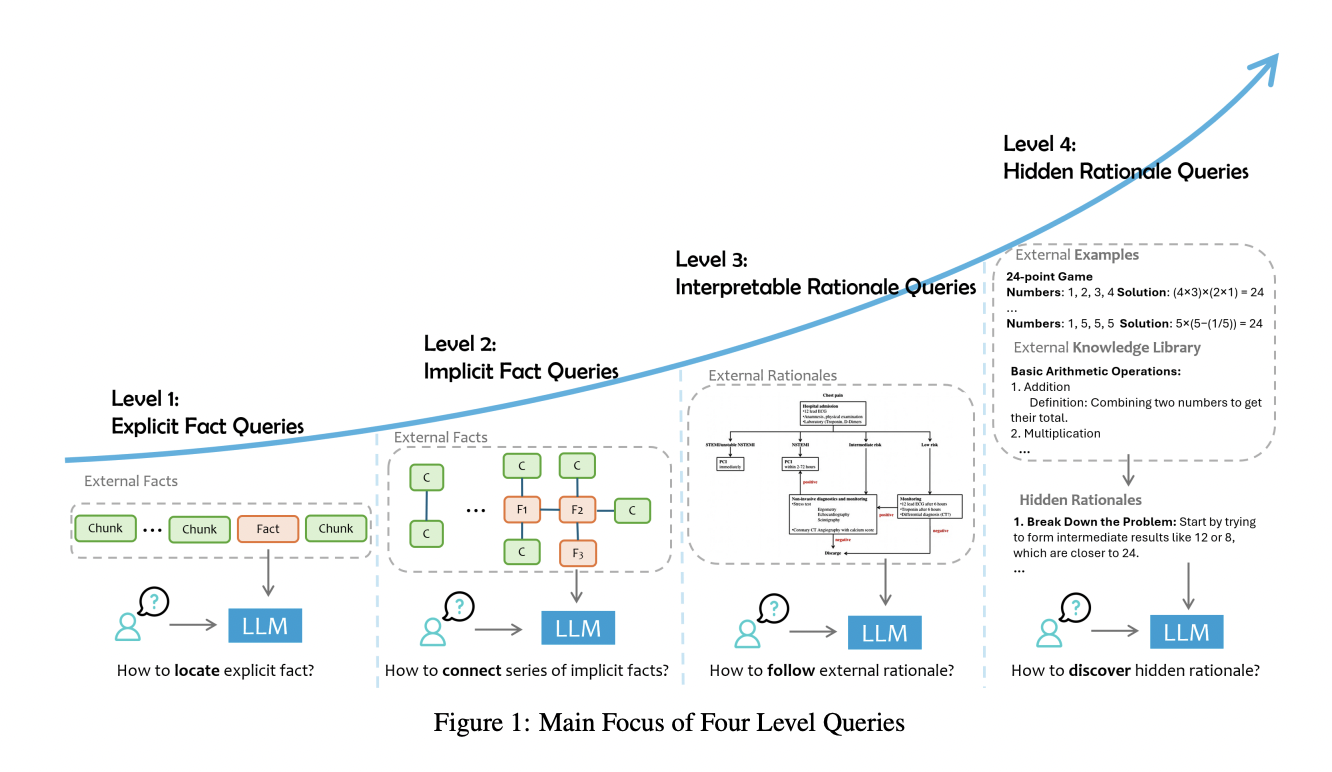

Исследователи из Microsoft Research Asia разработали метод категоризации запросов пользователей, что значительно улучшило работу моделей в сферах здравоохранения и юридического анализа.

Заключение:

Предложенный метод позволяет повысить точность и интерпретируемость выводов LLMs, что делает их более надежными в специализированных областях. Это значительный шаг вперед в применении ИИ-технологий в различных отраслях.

Подпишитесь на наш Telegram-канал: t.me/itinainews и Twitter: @itinairu45358 для новостей о ИИ и наших продуктах.