«`html

Модели языка: снижение затрат с помощью дистилляции

Модели языка становятся все более дорогими в обучении и эксплуатации. Это привело исследователей к поиску таких техник, как дистилляция моделей, где меньшая модель (студент) обучается повторять работу большей модели (учитель). Это позволяет эффективно развертывать модели без потери производительности.

Проблемы больших моделей

Увеличение размеров моделей машинного обучения приводит к высоким затратам и проблемам устойчивости. Обучение этих моделей требует значительных вычислительных ресурсов, а вычисления во время работы требуют еще больше. Затраты на вычисления могут превышать расходы на предобучение. К тому же большие модели создают логистические сложности: повышенное потребление энергии и трудности с развертыванием.

Решения для повышения эффективности

Ранее предложенные подходы включают оптимальное обучение и переобучение. Оптимальное обучение находит лучшую комбинацию размера модели и набора данных в рамках выделенного бюджета. Однако оба метода имеют свои недостатки, как-то: увеличение времени обучения и снижение улучшений производительности.

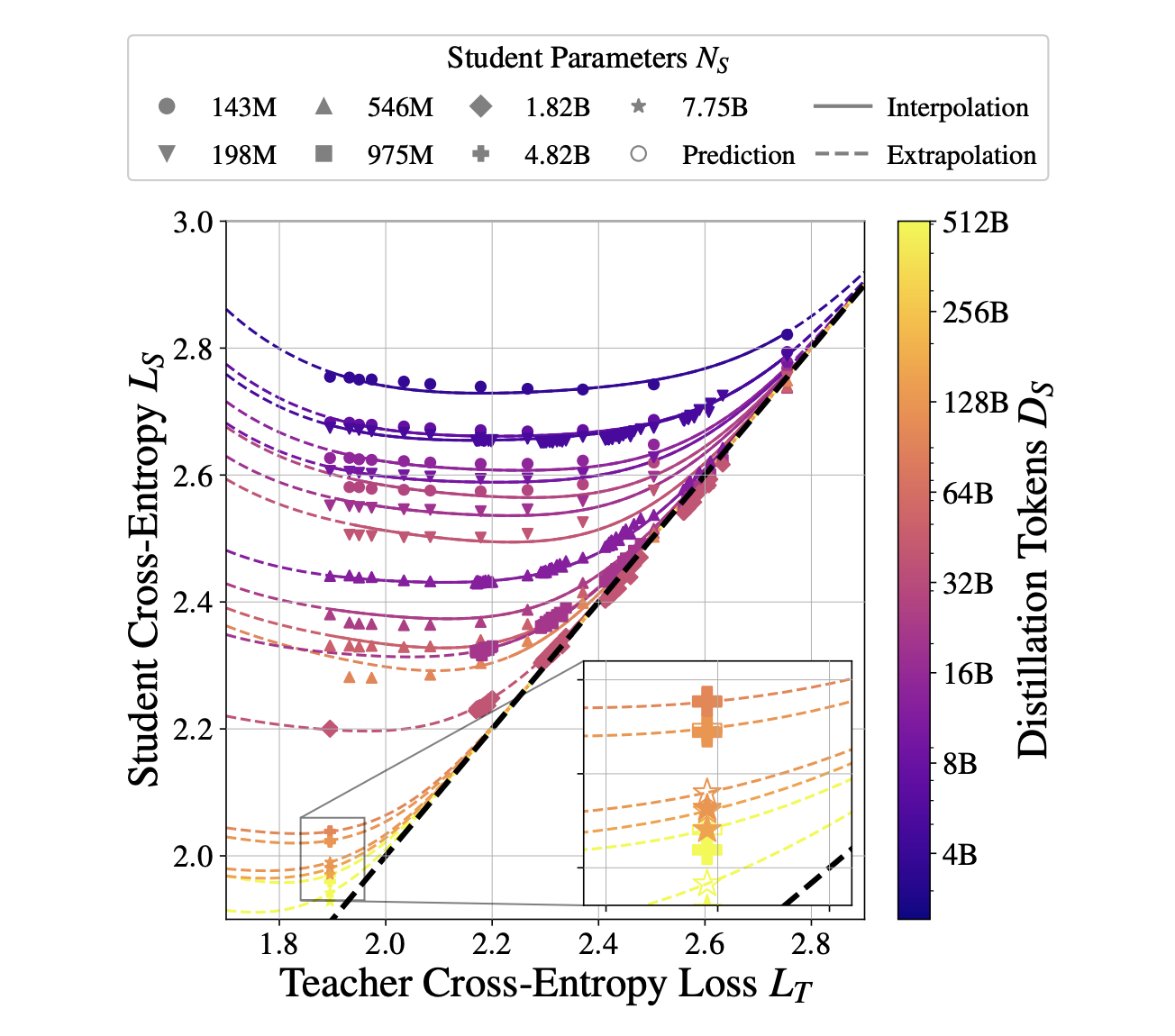

Дистилляция как ключ к экономии

Исследователи из Apple и Оксфорда представили закон масштабирования дистилляции, который предсказывает производительность дистиллированной модели на основе распределения бюджета вычислений. Это позволяет стратегически распределять ресурсы между учительской и студентской моделями.

Практические рекомендации

Закон дистилляции показывает, как зависит производительность студента от потерь учителя, размера набора данных и параметров модели. Исследования подтверждают, что дистилляция наиболее выгодна, когда существует учительская модель, и когда выделенные ресурсы не превышают определенного порога.

Преимущества дистилляции

Эмпирические результаты показывают, что модели, обученные с помощью дистилляции, могут достигать меньших потерь по сравнению с теми, что обучены с помощью традиционного обучения. Это делает дистилляцию практичным решением для повышения эффективности.

Как использовать ИИ в вашей компании

Если вы хотите, чтобы ваша компания развивалась с помощью искусственного интеллекта, грамотно используйте научные исследования, такие как закон масштабирования дистилляции.

Шаги к интеграции ИИ

- Проанализируйте, как ИИ может изменить вашу работу.

- Определите, где возможно автоматизировать процессы.

- Установите ключевые показатели эффективности (KPI), которые хотите улучшить.

- Выберите подходящее решение ИИ.

- Начните с малого проекта, анализируйте результаты и KPI, перед тем как расширять автоматизацию.

Получите помощь

Если вам нужны советы по внедрению ИИ, пишите нам. Следите за новостями о ИИ в нашем Telegram-канале и Twitter.

Попробуйте наш AI Sales Bot — он поможет вам отвечать на вопросы клиентов и генерировать контент для отдела продаж.

Узнайте, как ИИ может изменить ваши процессы с решениями от AI Lab. Будущее уже здесь!

«`