«`html

Искусственный интеллект (ИИ) в области обработки естественного языка (NLP)

Обработка естественного языка (NLP) сосредотачивается на том, чтобы позволить компьютерам понимать и генерировать человеческий язык, делая взаимодействие более интуитивным и эффективным. Недавние достижения в этой области значительно повлияли на машинный перевод, чат-ботов и автоматический анализ текста.

Текущие вызовы и практические решения

Однако, несмотря на значительные успехи в NLP, модели часто испытывают трудности в поддержании контекста при обработке длинных текстов и разговоров, что приводит к вызовам в генерации точных и актуальных ответов. Существующие исследования включают модели, такие как GPT, BERT, T5 и RoBERTa, но остаются проблемы с вычислительной эффективностью и сохранением контекста в длинных разговорах.

Новое решение: Llama-3-8B-Instruct-80K-QLoRA

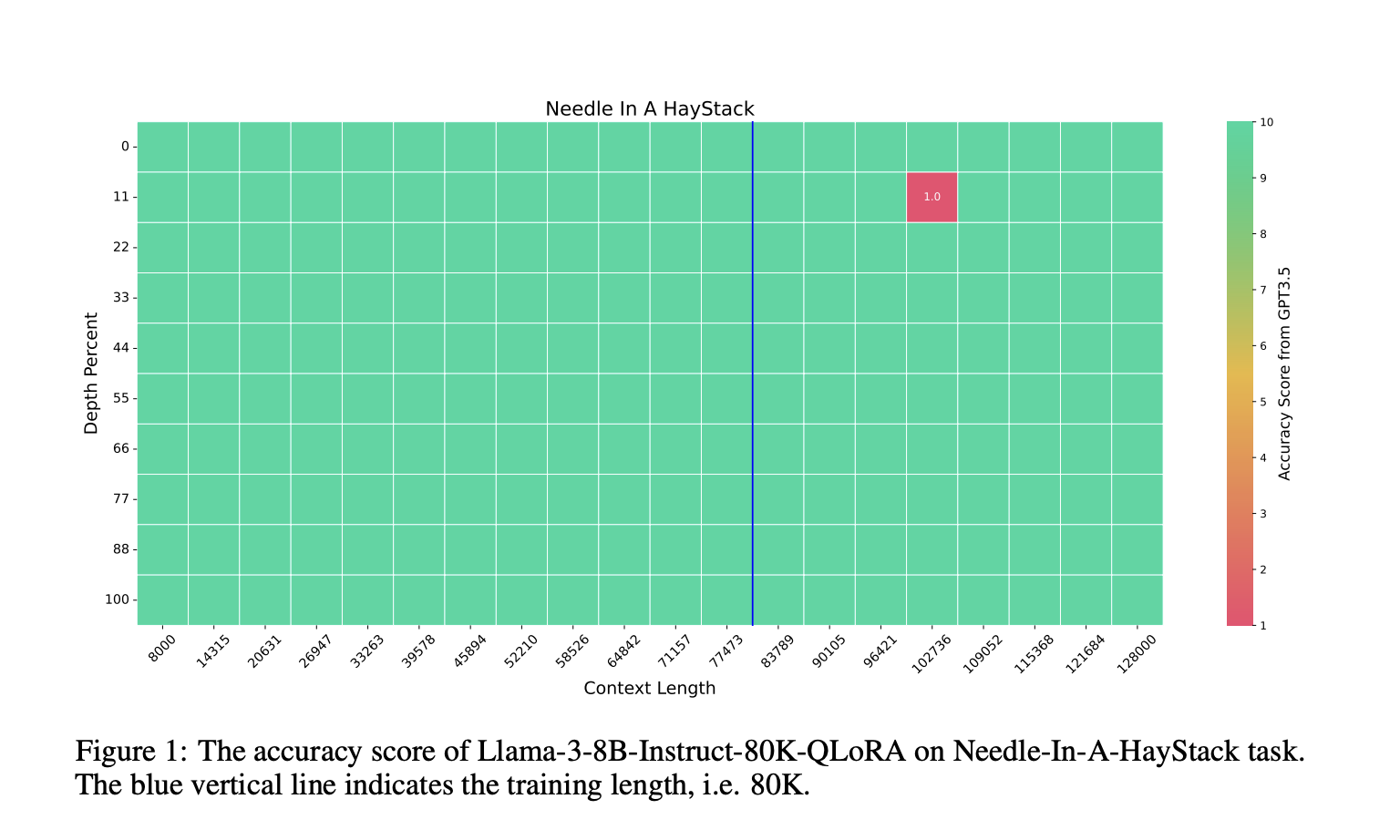

Исследователи из Beijing Academy of Artificial Intelligence и Renmin University of China представили Llama-3-8B-Instruct-80K-QLoRA, модель, которая значительно увеличивает длину контекста оригинальной модели Llama-3 с 8K до 80K токенов. Этот метод выделяется сохранением контекстного понимания в длинных текстовых последовательностях и снижением вычислительной нагрузки.

Результаты и преимущества модели

Модель продемонстрировала высокую точность в задачах, связанных с обработкой длинных текстов, а также показала конкурентоспособные результаты в оценках без обучения исходя из нулевых данных. Это значительный шаг вперед в исследованиях NLP, предлагая модель, способную эффективно понимать и обрабатывать более длинные контексты языка, что открывает путь для более продвинутых приложений обработки языка.

Ссылки и контакты

Подробнее о работе исследователей можно узнать в статье и на GitHub. Следите за новостями в нашем Telegram-канале и на Twitter.

«`