«`html

LLaVA-NeXT: Продвижения в Мультимодальном Понимании и Понимании Видео

В поисках Искусственного Общего Интеллекта, LLMs и LMMs стоят как замечательные инструменты, способные выполнять разнообразные задачи, сходные с человеческими. Оценка их возможностей является критически важной, но ландшафт раздроблен, с наборами данных, разбросанными по платформам, таким как Google Drive и Dropbox. lm-evaluation-harness устанавливает прецедент для оценки LLM, однако оценка мультимодальных моделей лишена унифицированной структуры. Этот разрыв подчеркивает начальный этап оценки мультимодальных моделей и требует согласованного подхода к оценке их производительности на различных наборах данных.

Практические решения и ценность:

LLaVA-NeXT — открытая пионерская LMM, обученная исключительно на текстово-изображенных данных, разработанная исследователями из Университета Наньянг Технолоджикал, Университета Висконсин-Мэдисон и Bytedance. Инновационная техника AnyRes улучшает рассуждения, оптическое распознавание символов (OCR) и мировые знания, демонстрируя исключительную производительность в различных задачах мультимодальных изображений. Превосходя Gemini-Pro на таких показателях, как MMMU и MathVista, LLaVA-NeXT означает значительный скачок в возможностях мультимодального понимания.

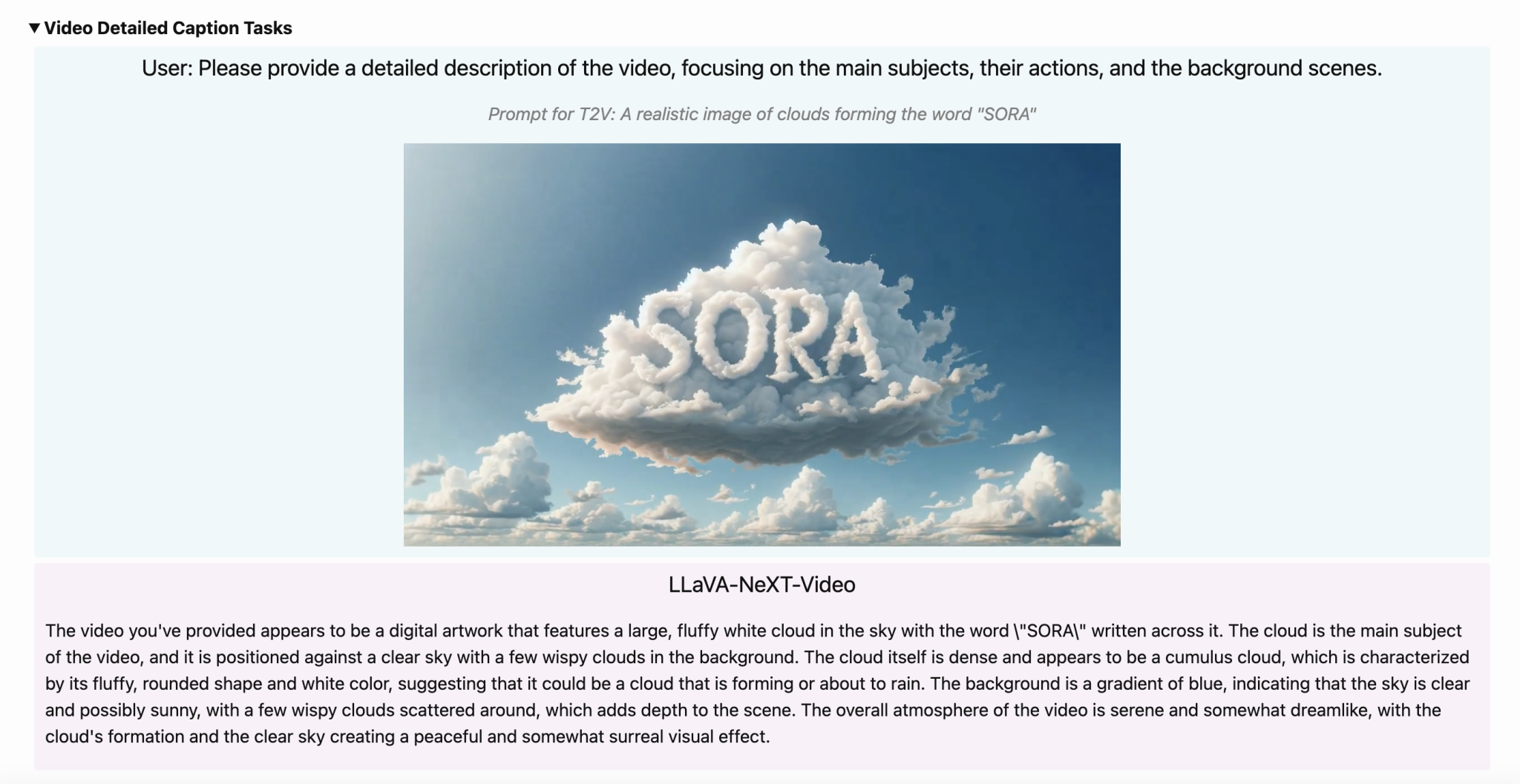

В области понимания видео LLaVA-NeXT неожиданно проявляет устойчивую производительность, обладая ключевыми улучшениями. Используя AnyRes, он достигает представления видео с нулевым обучением, обладая беспрецедентной способностью к переносу модальности для LMMs. Способность обобщения по длине модели эффективно обрабатывает более длинные видео, превосходя ограничения по длине токенов с помощью линейных методов масштабирования. Кроме того, надзорная донастройка (SFT) и оптимизация прямых предпочтений (DPO) улучшают способности понимания видео. В то же время эффективное развертывание через SGLang обеспечивает 5-кратное ускорение вывода, облегчая масштабируемые приложения, такие как переопределение миллионов видео. Достижения LLaVA-NeXT подчеркивают его современную производительность и универсальность в задачах мультимодальности, конкурируя с собственными моделями, такими как Gemini-Pro, на ключевых показателях.

Алгоритм AnyRes в LLaVA-NeXT — гибкая структура, которая эффективно обрабатывает изображения высокого разрешения. Он разбивает изображения на подизображения с использованием различных конфигураций сетки для достижения оптимальной производительности, соблюдая ограничения по длине токенов базовой архитектуры LLM. С некоторыми настройками он также может использоваться для обработки видео, но распределение токенов на кадр должно быть тщательно продумано, чтобы избежать превышения ограничений по токенам. Пространственные методы пулинга оптимизируют распределение токенов, балансируя количество кадров и плотность токенов. Однако эффективное захватывание всего видеоконтента остается сложной задачей при увеличении количества кадров.

Для обработки более длинных видеопоследовательностей LLaVA-NeXT реализует техники обобщения по длине, вдохновленные последними достижениями в обработке длинных последовательностей в LLMs. Модель может адаптировать более длинные последовательности путем масштабирования максимальной емкости токенов, улучшая ее применимость для анализа расширенного видеоконтента, и использование DPO позволяет использовать обратную связь, сгенерированную LLM, для обучения LLaVA-NeXT-Video, что приводит к существенному улучшению производительности. Этот подход предлагает экономически эффективную альтернативу получению данных о предпочтениях человека и показывает перспективы для улучшения методов обучения в мультимодальных контекстах.

Для эффективного представления видео в рамках ограничений LLM исследователи нашли оптимальную конфигурацию: выделение 12×12 токенов на кадр, выбор 16 кадров на видео и использование методов «линейного масштабирования» для дальнейшего улучшения возможностей донастройки, позволяющих обрабатывать более длинные последовательности токенов вывода. Донастройка LLaVA-NeXT-Video включает смешанный подход к обучению с видео- и изображенными данными. Смешивание типов данных внутри пакетов дает лучшую производительность, подчеркивая значимость включения изображений и видео во время обучения для улучшения профессионализма модели в задачах, связанных с видео.

Применение ИИ в вашем бизнесе

Если вы хотите, чтобы ваша компания развивалась с помощью искусственного интеллекта (ИИ) и оставалась в числе лидеров, грамотно используйте LLaVA-NeXT: Продвижения в Мультимодальном Понимании и Понимании Видео.

Проанализируйте, как ИИ может изменить вашу работу. Определите, где возможно применение автоматизации: найдите моменты, когда ваши клиенты могут извлечь выгоду из AI.

Определитесь какие ключевые показатели эффективности (KPI): вы хотите улучшить с помощью ИИ.

Подберите подходящее решение, сейчас очень много вариантов ИИ. Внедряйте ИИ решения постепенно: начните с малого проекта, анализируйте результаты и KPI.

На полученных данных и опыте расширяйте автоматизацию.

Если вам нужны советы по внедрению ИИ, пишите нам на https://t.me/itinai. Следите за новостями о ИИ в нашем Телеграм-канале t.me/itinainews или в Twitter @itinairu45358.

Попробуйте AI Sales Bot https://itinai.ru/aisales. Этот AI ассистент в продажах помогает отвечать на вопросы клиентов, генерировать контент для отдела продаж, снижать нагрузку на первую линию.

Узнайте, как ИИ может изменить ваши процессы с решениями от AI Lab itinai.ru. Будущее уже здесь!

«`