Применение технологий ИИ для улучшения защиты в машинном обучении на табличных данных

Технология

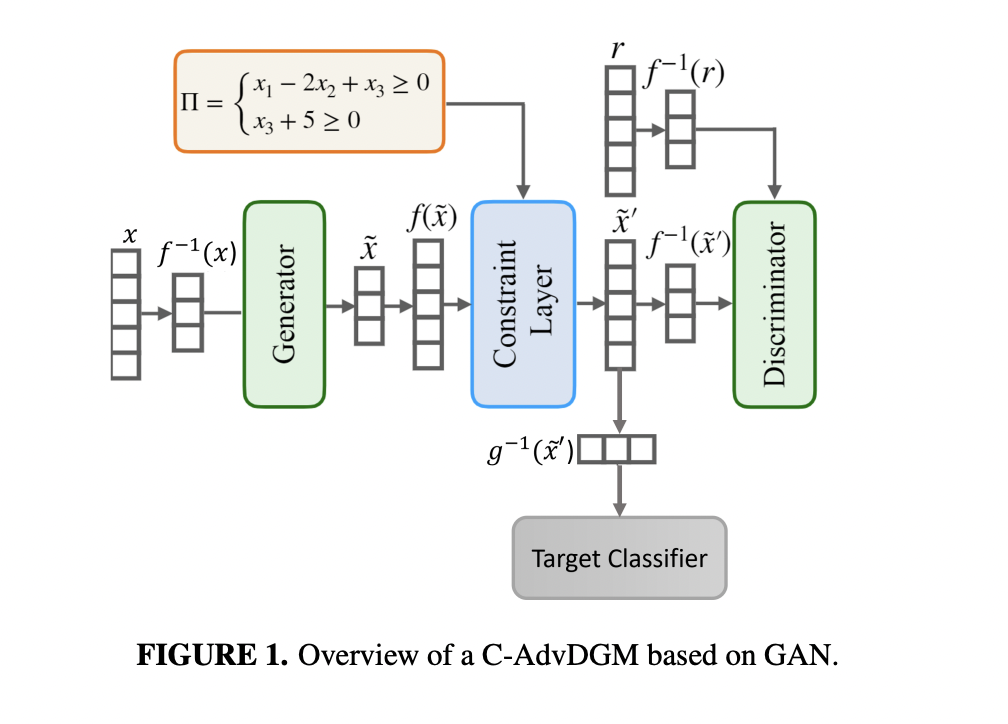

Исследования в области адверсариального машинного обучения сосредотачиваются на проверке и улучшении стойкости систем машинного обучения (ML) с помощью адверсариальных примеров. Глубокие генеративные модели (DGM) показали значительный потенциал в создании таких адверсариальных примеров, особенно в компьютерном зрении. Однако расширение этой техники на другие типы данных, такие как табличные данные, вносит дополнительные вызовы из-за необходимости моделей поддерживать реалистичные отношения между признаками.

Практические решения

Исследователи предложили создание ограниченных адверсариальных DGM (C-AdvDGM), которые позволяют генерировать адверсариальные данные, изменяющие прогнозы ML моделей и соблюдающие логические правила и отношения в наборе данных.

Значимость

Это исследование устраняет важный пробел в адверсариальном машинном обучении для табличных данных. Успех модели AdvWGAN, достигший ASR 95% на наборе данных Heloc, указывает на потенциал этого метода для повышения надежности ML моделей в областях, требующих структурированных и реалистичных адверсариальных данных. Такой подход открывает путь к более надежной оценке безопасности в ML системах и демонстрирует важность соблюдения ограничений при создании адверсариальных примеров.