«`html

Визуальные языковые модели (VLMs) и их практическое применение

Основные проблемы и развитие

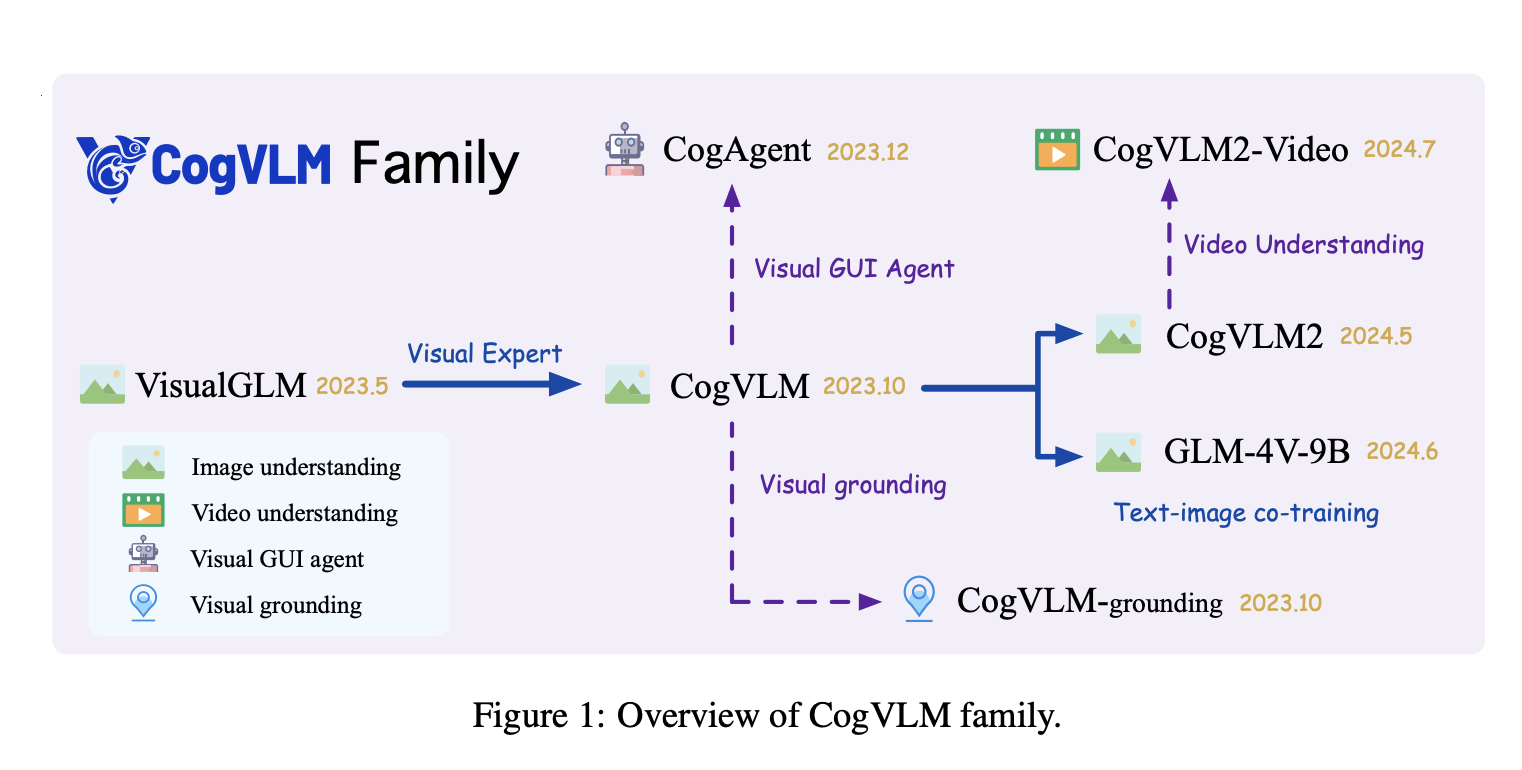

Большие языковые модели (LLMs), изначально ориентированные на обработку текста, столкнулись с трудностями в понимании визуальных данных. Это привело к разработке визуальных языковых моделей (VLMs), которые объединяют визуальное понимание с обработкой языка. Ранние модели, такие как VisualGLM, основанные на архитектурах BLIP-2 и ChatGLM-6B, представляли собой первые попытки мультимодальной интеграции. Однако эти модели часто полагались на поверхностные техники выравнивания, ограничивая глубину визуальной и языковой интеграции, что подчеркивает необходимость более продвинутых подходов.

Практические применения

Последующие усовершенствования в архитектуре VLM, воплощенные в моделях, таких как CogVLM, сосредоточились на достижении более глубокого слияния визуальных и языковых особенностей, тем самым улучшая естественную языковую производительность. Разработка специализированных наборов данных, таких как синтетический набор данных OCR, сыграла решающую роль в улучшении возможностей моделей OCR, позволяя их более широкое применение в анализе документов, понимании графического интерфейса и понимании видео. Эти инновации значительно расширили потенциал LLM, способствуя эволюции визуальных языковых моделей.

Новое поколение моделей CogVLM2

Исследовательская статья от Zhipu AI и Университета Цинхуа представляет семейство CogVLM2, новое поколение визуальных языковых моделей, разработанных для улучшенного понимания изображений и видео, включая модели, такие как CogVLM2, CogVLM2-Video и GLM-4V. Усовершенствования включают в себя архитектуру более высокого разрешения для распознавания изображений, изучение более широких модальностей, таких как визуальное выравнивание и агенты графического интерфейса, а также инновационные техники, такие как пост-дискретизация для эффективной обработки изображений. Статья также подчеркивает обязательство открытого исходного кода этих моделей, предоставляя ценные ресурсы для дальнейших исследований и разработок в области визуальных языковых моделей.

Практические результаты и применение

Семейство CogVLM2 интегрирует архитектурные инновации, включая Visual Expert и кросс-модули высокого разрешения, для улучшения слияния визуальных и языковых особенностей. Процесс обучения для CogVLM2-Video включает два этапа: настройку инструкций с использованием подробных данных о подписях и наборов данных вопросов и ответов с коэффициентом обучения 4e-6, а также настройку временного выравнивания на наборе данных TQA с коэффициентом обучения 1e-6. Обработка видеовхода использует 24 последовательных кадра, с добавлением сверточного слоя к модели Vision Transformer для эффективного сжатия видеофункций.

Методология CogVLM2 использует обширные наборы данных, включая 330 000 видеопримеров и внутренний набор данных для видео QA, для улучшения временного понимания. Оценочный процесс включает в себя создание и оценку подписей к видео с использованием GPT-4o для фильтрации видео на основе изменений содержания сцены. Два варианта моделей, cogvlm2-video-llama3-base и cogvlm2-video-llama3-chat, обслуживают различные сценарии применения, последний настроен для улучшенного временного выравнивания. Процесс обучения происходит на 8-узловом кластере NVIDIA A100 и занимает приблизительно 8 часов.

В частности модель CogVLM2-Video достигает передовой производительности в нескольких задачах видеовопросов и ответов, превосходя бенчмарки, такие как MVBench и VideoChatGPT-Bench. Модели также превосходят существующие модели, включая более крупные, в задачах, связанных с изображениями, с заметным успехом в понимании OCR, понимании диаграмм и общем вопросно-ответном процессе. Комплексная оценка показывает универсальность моделей в задачах, таких как генерация и суммирование видео, утверждая CogVLM2 как новый стандарт для визуальных языковых моделей в понимании как изображений, так и видео.

Заключение и практические рекомендации

Семейство CogVLM2 представляет собой значительное усовершенствование в интеграции визуальных и языковых модальностей, решая ограничения традиционных моделей, ориентированных только на текст. Разработка моделей, способных интерпретировать и генерировать контент изображений и видео, расширяет их применение в областях, таких как анализ документов, понимание графического интерфейса и понимание видео. Архитектурные инновации, включая Visual Expert и кросс-модули высокого разрешения, улучшают производительность в сложных визуально-языковых задачах. Серия CogVLM2 устанавливает новый стандарт для открытых визуальных языковых моделей, с подробными методиками создания наборов данных, поддерживающими их надежные возможности и будущие исследовательские возможности.

Посмотрите исследование и GitHub. Вся заслуга за это исследование принадлежит исследователям этого проекта. Также не забудьте подписаться на нас в Twitter и LinkedIn. Присоединяйтесь к нашему Telegram-каналу.

Если вам нравится наша работа, вам понравится наш новостной бюллетень.

Не забудьте присоединиться к нашему 50k+ ML SubReddit.

Применение искусственного интеллекта в вашем бизнесе

Оптимизация бизнес-процессов с помощью ИИ

Если вы хотите, чтобы ваша компания развивалась с помощью искусственного интеллекта (ИИ) и оставалась в числе лидеров, грамотно используйте CogVLM2: Advancing Multimodal Visual Language Models for Enhanced Image, Video Understanding, and Temporal Grounding in Open-Source Applications.

Практические шаги по внедрению ИИ

Проанализируйте, как ИИ может изменить вашу работу. Определите, где возможно применение автоматизации: найдите моменты, когда ваши клиенты могут извлечь выгоду из AI. Определитесь какие ключевые показатели эффективности (KPI): вы хотите улучшить с помощью ИИ. Подберите подходящее решение, сейчас очень много вариантов ИИ. Внедряйте ИИ решения постепенно: начните с малого проекта, анализируйте результаты и KPI. На полученных данных и опыте расширяйте автоматизацию.

Получение консультаций и использование AI-решений

Если вам нужны советы по внедрению ИИ, пишите нам на Telegram. Следите за новостями о ИИ в нашем Телеграм-канале или в Twitter.

Попробуйте AI Sales Bot. Этот AI ассистент в продажах помогает отвечать на вопросы клиентов, генерировать контент для отдела продаж и снижать нагрузку на первую линию.

Узнайте, как ИИ может изменить ваши процессы с решениями от AI Lab itinai.ru. Будущее уже здесь!

«`