«`html

Увеличение энергоэффективности в инференции больших языковых моделей (LLM)

Практические решения и ценность

Генеративные большие языковые модели (LLM) стали неотъемлемой частью многих приложений благодаря своему быстрому росту и широкому использованию. Однако их выполнение на мощных графических процессорах (GPU) потребляет много энергии и увеличивает выбросы углекислого газа.

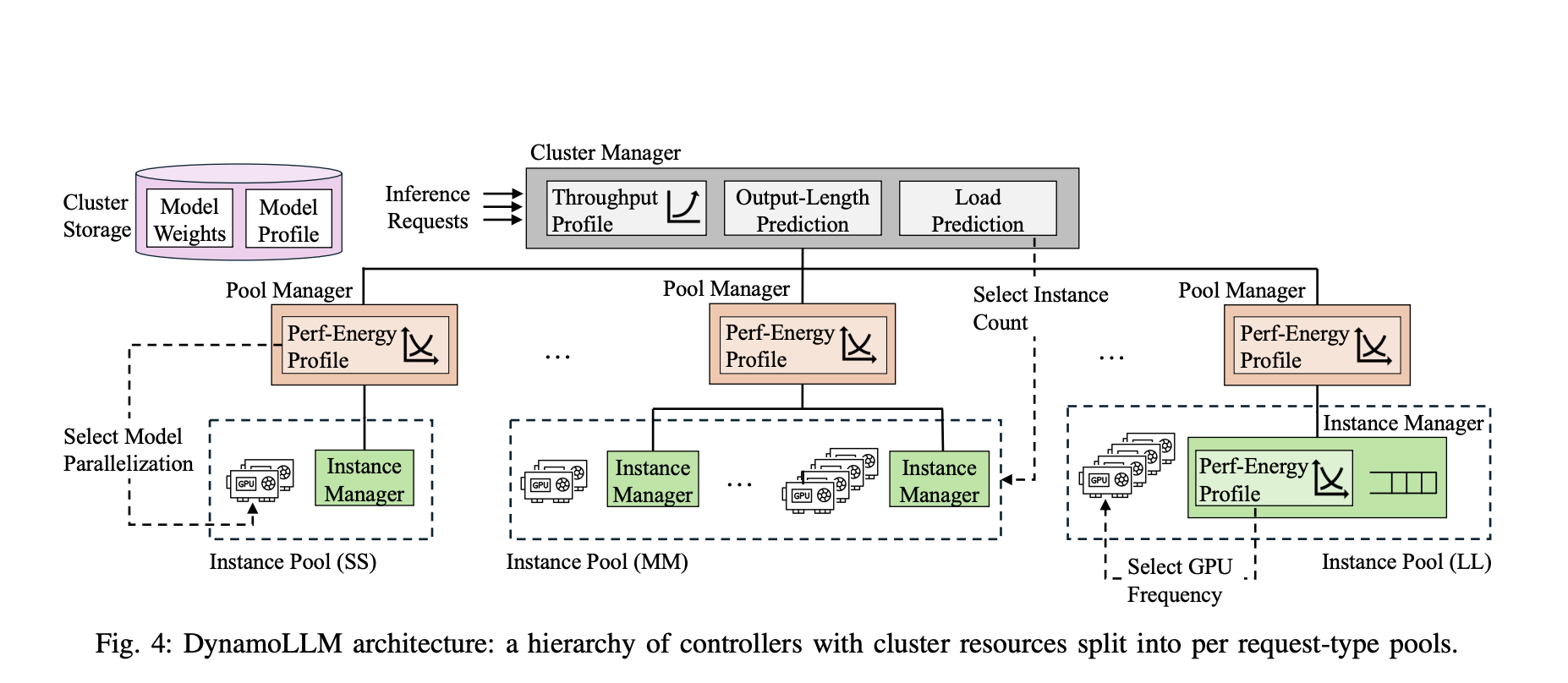

Для оптимизации энергоэффективности инференции LLM была разработана уникальная система управления энергией под названием DynamoLLM. Она автоматически и динамически перенастраивает кластеры инференции, обеспечивая выполнение требований по производительности и снижая энергопотребление.

Используя реальные данные, DynamoLLM позволяет сэкономить до 53% энергии, снизить цены для потребителей на 61% и выбросы углекислого газа на 38%, сохраняя при этом требуемый уровень отклика сервиса.

Это значительный прорыв в улучшении устойчивости и экономики LLM, решая финансовые и экологические проблемы в области искусственного интеллекта.

Подробнее ознакомьтесь с исследованием.

А также не забудьте подписаться на наш Twitter и присоединиться к нашим группам в Telegram и LinkedIn. Если вам нравится наша работа, вам понравится и наша рассылка.

Не забудьте присоединиться к нашему сообществу в Reddit ML SubReddit.

Также узнайте о предстоящих вебинарах по искусственному интеллекту здесь.

Arcee AI выпустила DistillKit: Open Source-инструмент для создания эффективных малых языковых моделей. Подробнее.