«`html

Что такое галлюцинации в LLM и 6 эффективных стратегий их предотвращения

Галлюцинации в больших языковых моделях (LLM) – это случаи, когда модели генерируют правдоподобные, но фактически неверные или бессмысленные ответы. Например, модель может ошибочно утверждать, что болезнь Аддисона вызывает «ярко-желтую кожу», хотя на самом деле она вызывает усталость и низкое кровяное давление. Это серьезная проблема в ИИ, так как может привести к распространению ложной информации. Понимание и снижение галлюцинаций в ИИ-системах крайне важно для их надежного использования. Ниже представлены шесть способов предотвращения галлюцинаций в LLM:

1. Используйте качественные данные

Качественные данные – это основа для обучения модели. Если в датасете не хватает информации о редких болезнях, модель может давать неправильные ответы. Использование широких и точных наборов данных снижает риски ошибок.

2. Используйте шаблоны данных

Шаблоны данных помогают сохранить контроль и точность. Они задают ожидаемый формат и диапазон ответов. Например, в финансовой отчетности шаблон может определить необходимые поля для баланса, что обеспечивает согласованность и правильность ответов.

3. Настройка параметров

Настройка параметров позволяет адаптировать поведение модели под конкретные задачи. Изменяя параметры, такие как температура, можно регулировать креативность и точность ответов, что улучшает результат в зависимости от контекста.

4. Инженерия запросов

Качественная формулировка запросов помогает снизить количество галлюцинаций. Четкие инструкции и примеры вопросов повышают качество ответов. Например, запрос «Как финансовый эксперт, объясните, как инфляция влияет на процентные ставки» задает ясные ожидания.

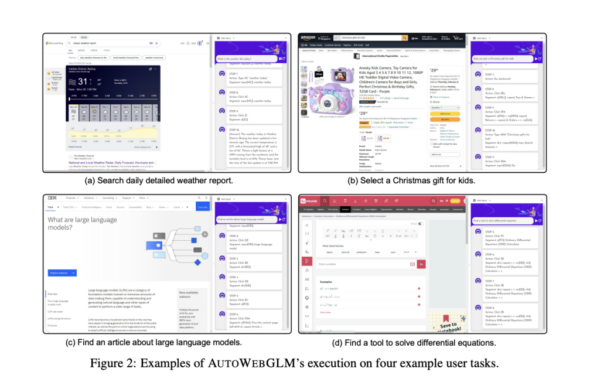

5. Генерация с поддержкой поиска (RAG)

RAG сочетает генеративные возможности ИИ с внешними источниками знаний. Это позволяет модели основываться на фактической информации, а не только на обучающих данных, что увеличивает точность ответов.

6. Проверка фактов людьми

Человеческий контроль важен для предотвращения галлюцинаций. Проверяющие факты могут выявлять и исправлять ошибки, что особенно важно в критически важных ситуациях, как в новостях или юридических документах.

Преимущества снижения галлюцинаций в LLM

- Увеличение доверия: Снижение галлюцинаций повышает надежность систем ИИ, что критично для здравоохранения и юриспруденции.

- Улучшение точности: Точные ответы способствуют уверенности пользователей и более широкому принятию технологий ИИ.

- Предотвращение дезинформации: Снижение галлюцинаций помогает избегать ошибок в финансах и медицине.

- Соответствие этическим стандартам: Устранение ложной информации способствует соблюдению этических норм.

- Экономия ресурсов: Точные ответы уменьшают необходимость в проверке и исправлении, экономя время и ресурсы.

- Улучшение разработки моделей: Работа с галлюцинациями позволяет улучшать данные и технологии ИИ.

Заключение

Эти шесть стратегий помогают решить проблему галлюцинаций и обеспечивают надежную основу для работы ИИ. Качественные данные и шаблоны обеспечивают основу, настройка параметров и инженерия запросов улучшают результаты, а RAG и человеческий контроль служат дополнительной защитой от ошибок.

Если вы хотите, чтобы ваша компания развивалась с помощью ИИ, используйте эти стратегии. Анализируйте, как ИИ может помочь вашей работе, определяйте ключевые показатели эффективности и внедряйте подходящие решения поэтапно.

Если вам нужна помощь по внедрению ИИ, пишите нам в Телеграм. Следите за новостями о ИИ в нашем Телеграм-канале.

«`