«`html

Усовершенствование возможностей машинного обучения в области обработки естественного языка

Обработка естественного языка (Natural Language Processing, NLP) обучает компьютеры понимать, интерпретировать и генерировать человеческий язык. Одной из основных задач исследователей в этой области является улучшение возможностей логического мышления моделей языка для эффективного решения сложных задач. Это включает развитие способностей моделей обрабатывать и генерировать текст, требующий логических шагов и последовательных мыслительных процессов.

Проблема и ее решение

Одной из основных проблем в области NLP является обеспечение точного и эффективного решения задач логического мышления моделей языка. Традиционные модели часто полагаются на генерацию явных промежуточных шагов, что может быть вычислительно затратно и неэффективно. Улучшая точность, эти промежуточные шаги требуют значительных вычислительных ресурсов и могут не полностью использовать потенциал моделей. Центральной проблемой является нахождение способа внутреннего включения процессов логического мышления в модели для поддержания высокой точности и снижения вычислительной нагрузки.

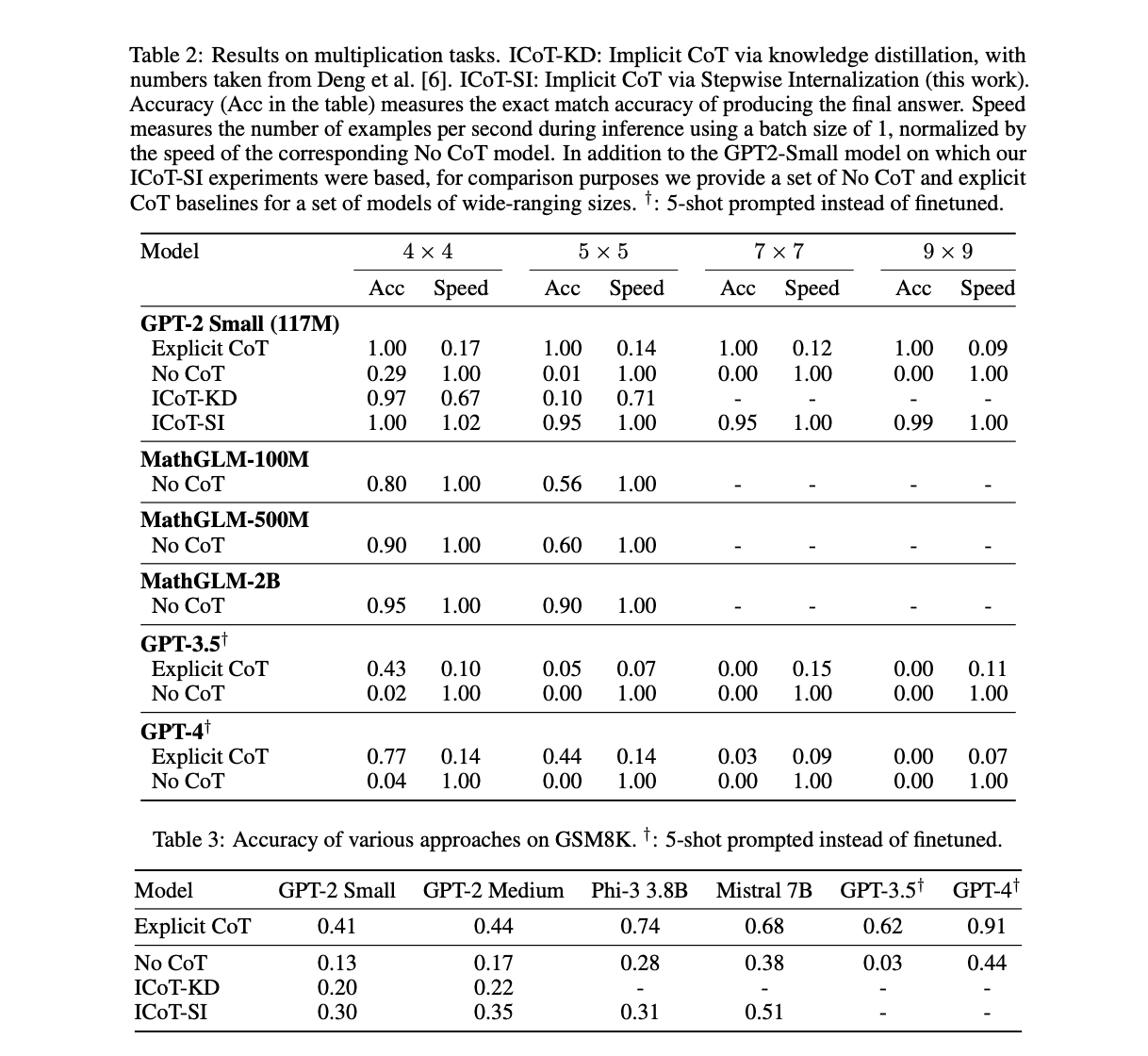

Существующие работы включают методы явного цепного мышления (CoT), которые генерируют промежуточные логические шаги для улучшения точности, но требуют значительных вычислительных ресурсов. Напротив, неявное цепное мышление через дистилляцию знаний (ICoT-KD) обучает модели, используя скрытые состояния для логического мышления без явных шагов. Методы, такие как MathGLM, решают многозначные арифметические задачи без промежуточных шагов, достигая высокой точности с помощью больших моделей. Другой подход, Searchformer, обучает трансформеры выполнять поиск с меньшим количеством шагов. Эти методы направлены на повышение эффективности и точности в задачах обработки естественного языка.

Исследователи из Allen Institute for Artificial Intelligence, University of Waterloo, University of Washington и Harvard University предложили метод Stepwise Internalization для решения этой проблемы. Этот инновационный метод начинается с обучения модели для явного цепного мышления и постепенно удаляет промежуточные шаги, тонко настраивая модель. Этот процесс помогает модели внутренне включить логические шаги, упрощая процесс мышления и сохраняя производительность.

Результаты и преимущества

Предложенный метод показал значительные улучшения производительности в различных задачах. Например, модель GPT-2 Small, обученная с использованием метода Stepwise Internalization, решала умножение 9 на 9 с точностью до 99%. В свою очередь, модели, обученные стандартными методами, испытывали трудности с задачами умножения размером более 4 на 4. Кроме того, модель Mistral 7B достигла более 50% точности на наборе данных GSM8K, состоящем из математических задач начальной школы, без генерации явных промежуточных шагов. Такая производительность превосходит даже гораздо большую модель GPT-4, которая набрала всего 44% при попытке сразу же сгенерировать ответ. Кроме того, Stepwise Internalization обеспечивает значительную вычислительную эффективность. На задачах, требующих явного цепного мышления, этот метод оказался в 11 раз быстрее при сохранении высокой точности.

Заключение

Данное исследование выделяет многообещающий подход к улучшению возможностей логического мышления моделей языка. Путем внутреннего включения шагов цепного мышления метод Stepwise Internalization предлагает баланс между точностью и вычислительной эффективностью. Этот метод представляет собой значительный прорыв в потенциальном изменении способа обработки сложных логических задач в рамках NLP. Возможность внутреннего включения логических шагов в скрытые состояния может открыть путь к более эффективным и способным моделям языка, что делает их более практичными для различных приложений. Исследование подчеркивает потенциал этого инновационного подхода, указывая на то, что дальнейшее развитие и масштабирование могут привести к еще более впечатляющим результатам в будущем.

Ознакомьтесь с научной статьей. Вся заслуга за это исследование принадлежит ученым этого проекта. Также не забудьте подписаться на нас в Twitter. Присоединяйтесь к нашему каналу в Telegram, Discord и LinkedIn.

Если вам понравилась наша работа, вам понравится и наш новостной бюллетень.

Не забудьте присоединиться к нашему сообществу на Reddit. Также ознакомьтесь с нашей платформой мероприятий по ИИ.

Оригинал статьи: From Explicit to Implicit: Stepwise Internalization Ushers in a New Era of Natural Language Processing Reasoning

«`

«`html

Практическое применение искусственного интеллекта в бизнесе

Если вы хотите, чтобы ваша компания развивалась с помощью искусственного интеллекта (ИИ) и оставалась в числе лидеров, грамотно используйте новые технологии, такие как From Explicit to Implicit: Stepwise Internalization Ushers in a New Era of Natural Language Processing Reasoning.

Проанализируйте, как ИИ может изменить вашу работу. Определите, где возможно применение автоматизации: найдите моменты, когда ваши клиенты могут извлечь выгоду из AI.

Определитесь какие ключевые показатели эффективности (KPI): вы хотите улучшить с помощью ИИ.

Подберите подходящее решение, сейчас очень много вариантов ИИ. Внедряйте ИИ решения постепенно: начните с малого проекта, анализируйте результаты и KPI.

На полученных данных и опыте расширяйте автоматизацию.

Если вам нужны советы по внедрению ИИ, пишите нам на Telegram. Следите за новостями о ИИ в нашем Телеграм-канале или в Twitter.

Попробуйте AI Sales Bot. Этот AI ассистент в продажах помогает отвечать на вопросы клиентов, генерировать контент для отдела продаж, снижать нагрузку на первую линию.

Узнайте, как ИИ может изменить ваши процессы с решениями от AI Lab. Будущее уже здесь!

«`