«`html

Эффективные решения для крупных языковых моделей

Крупные языковые модели (LLM) обрабатывают большие объемы данных, чтобы выдавать связные результаты. Они разбивают сложные задачи на последовательные шаги, что напоминает человеческое логическое мышление. Главный вызов — генерировать структурированные ответы, требующий много вычислительных ресурсов и больших наборов данных.

Проблемы и решения

Основная трудность в обучении LLM заключается в создании длинных ответов с саморефлексией и проверкой. Существующие модели требуют значительных затрат на обучение. Поэтому ученые ищут новые методы, которые оптимизируют эффективность и требуют меньше данных.

Традиционные подходы, такие как полное супервизированное обучение и техники, например Low-Rank Adaptation (LoRA), помогают улучшить процессы, не требуя переобучения на больших наборах данных. Однако многие модели все еще требуют много данных для достижения точности.

Новый метод обучения

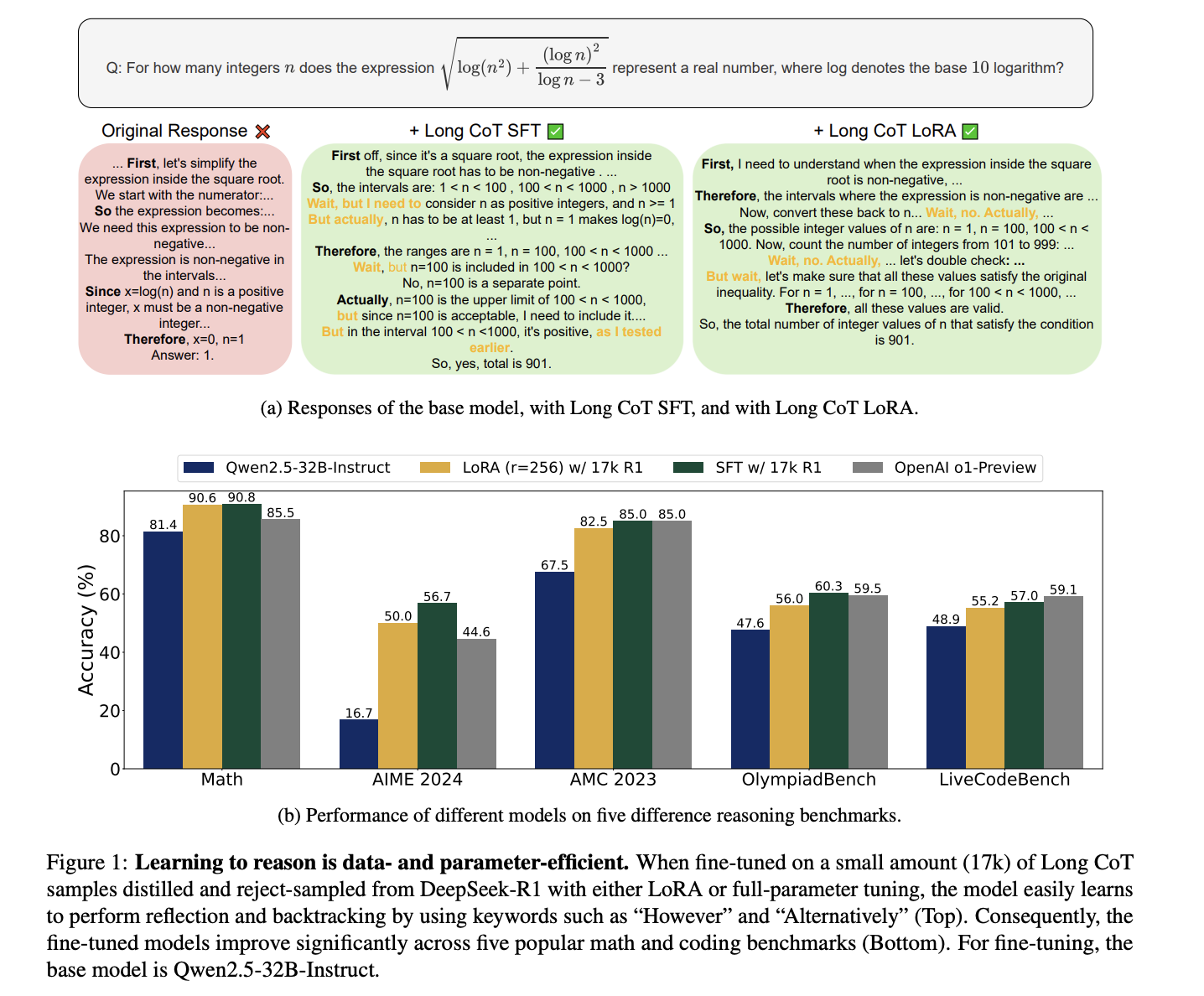

Исследовательская группа из UC Berkeley разработала новый подход, который позволяет улучшить работу LLM с минимальными данными. Вместо миллионов примеров они использовали только 17,000 примеров, применив SFT и LoRA для значительного улучшения производительности.

Метод фокусируется на оптимизации структуры логических шагов, а не на содержании. Это позволяет моделям работать эффективнее, снижая вычислительные затраты и расширяя доступность для различных приложений.

Результаты и достижения

Новый подход продемонстрировал значительные улучшения в способности LLM к логическому мышлению. Модель Qwen2.5-32B-Instruct, обученная на 17,000 примерах, показала 56.7% точности на AIME 2024, что на 40.0% лучше, чем предыдущие результаты. Другие достижения включают 90.8% на Math-500 и 60.3% на OlympiadBench.

Перспективы и применение ИИ

Это исследование демонстрирует важный прорыв в эффективности обучения LLM. Перевод фокуса с больших данных на структурную целостность позволяет создать методику обучения с минимальными вычислительными ресурсами. Результаты этого исследования открывают новые горизонты для оптимизации будущих моделей.

Если вы хотите развивать свою компанию с помощью ИИ и оставаться в числе лидеров, следуйте этим шагам:

- Анализируйте, как ИИ может изменить вашу работу.

- Определите ключевые показатели эффективности, которые хотите улучшить с помощью ИИ.

- Выберите подходящие ИИ решения и внедряйте их постепенно.

- На основе полученных результатов расширяйте автоматизацию.

Если вам нужны советы по внедрению ИИ, свяжитесь с нами. Узнайте, как ИИ может изменить ваши процессы с решениями от AI Lab, будущее уже здесь!

«`