«`html

Индуктивные предпочтения в глубоком обучении: понимание представления признаков

Исследования в области машинного обучения направлены на изучение представлений, которые обеспечивают эффективное выполнение задач. Растущее подполе стремится интерпретировать роли этих представлений в поведении модели или модифицировать их для улучшения соответствия, интерпретируемости или обобщения. Подобно этому, нейронаука изучает нейрональные представления и их корреляции с поведением. Обе области сосредотачиваются на понимании или улучшении вычислительных систем, абстрактных поведенческих шаблонов задач и их реализаций. Взаимосвязь между представлением и вычислением сложна и требует более ясного подхода.

Практические решения и ценность

Глубокие сети с высокой степенью параметризации часто обобщают хорошо, несмотря на их способность к запоминанию, что указывает на неявный индуктивный эффект в пользу простоты в их архитектуре и динамике обучения на основе градиентов. Сети, смещенные в сторону более простых функций, облегчают обучение более простых признаков, что может повлиять на внутренние представления даже для сложных признаков. Предпочтения представления содействуют простым, общим признакам, под влиянием таких факторов, как распространенность признака и позиция вывода в трансформаторах. Исследование обучения сокращенных путей и дезентанглированных представлений подчеркивает, как эти предпочтения влияют на поведение сети и обобщение.

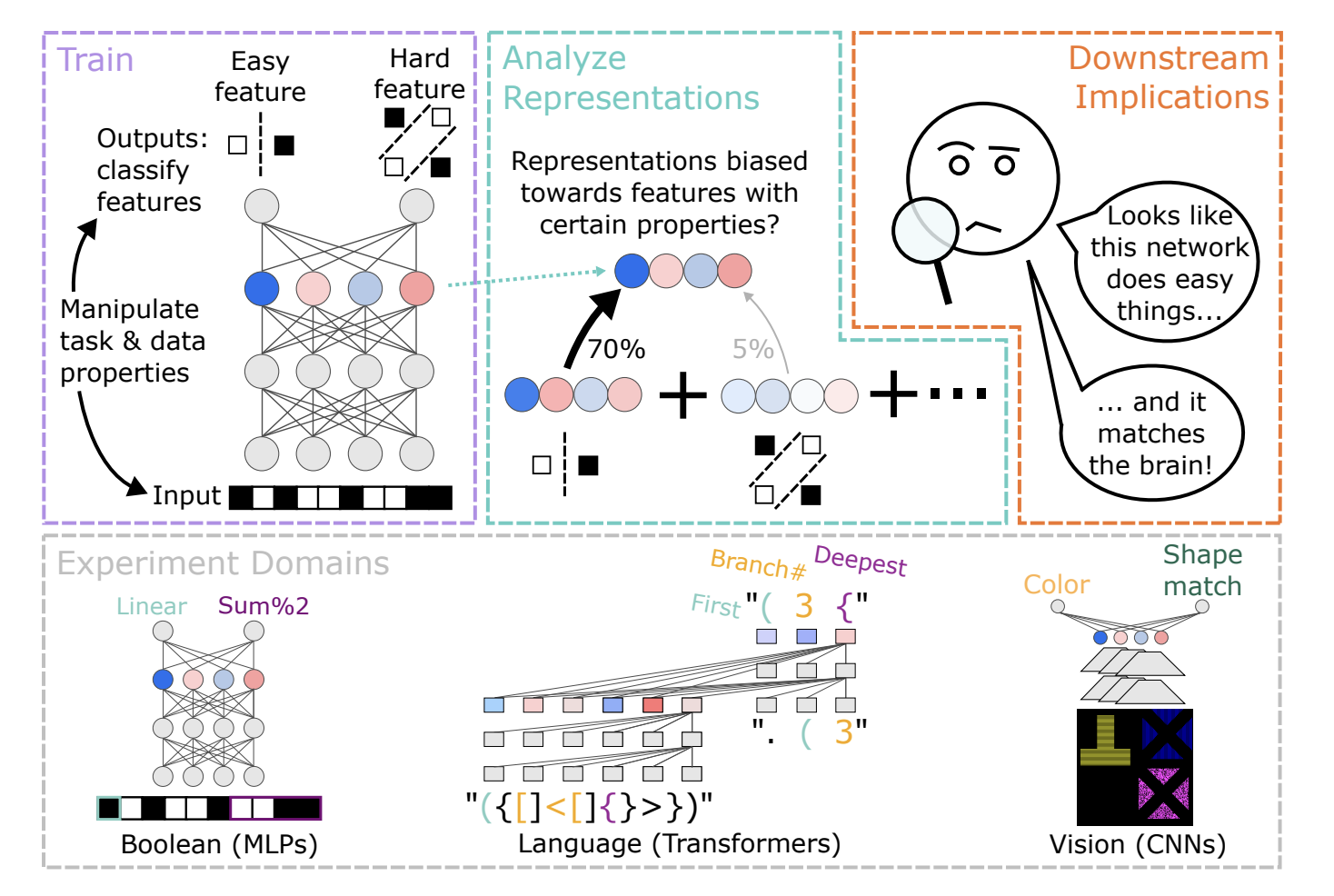

В данной работе исследователи DeepMind исследуют расхождения между представлением и вычислением, создавая наборы данных, которые соответствуют вычислительным ролям признаков, изменяя их свойства. Различные архитектуры глубокого обучения обучаются для вычисления нескольких абстрактных признаков из входных данных. Результаты показывают систематические предпочтения в представлении признаков на основе таких свойств, как сложность признака, порядок обучения и распределение признаков. Простые или раньше выученные признаки более ярко представлены, чем сложные или позднее выученные. Эти предпочтения зависят от архитектур, оптимизаторов и режимов обучения, таких как трансформаторы, предпочитающие признаки, декодируемые раньше в последовательности вывода.

Их подход включает обучение сетей классифицировать несколько признаков либо через отдельные выходные блоки (например, MLP), либо как последовательность (например, трансформатор). Наборы данных созданы так, чтобы обеспечить статистическую независимость между признаками, и модели достигают высокой точности (>95%) на контрольных тестовых наборах, подтверждая правильное вычисление признаков. Исследование изучает, какие свойства, такие как сложность признака, распространенность и позиция в последовательности вывода, влияют на представление признака. Созданы семейства наборов данных для систематического воздействия на эти свойства, с соответствующими контрольными и тестовыми наборами, обеспечивающими ожидаемое обобщение.

Обучение различных архитектур глубокого обучения для вычисления нескольких абстрактных признаков показывает систематические предпочтения в представлении признаков. Эти предпочтения зависят от внешних свойств, таких как сложность признака, порядок обучения и распределение признаков. Простые или раньше выученные признаки представлены более ярко, чем сложные или позднее выученные, даже если все они выучены одинаково хорошо. Архитектуры, оптимизаторы и режимы обучения, такие как трансформаторы, также влияют на эти предпочтения. Эти результаты характеризуют индуктивные предпочтения градиентного представительного обучения и подчеркивают вызовы в разделении внешних предпочтений от вычислительно важных аспектов для интерпретации и сравнения с представлениями мозга.

В данной работе исследователи обучали модели глубокого обучения вычислять несколько входных признаков, выявляя существенные предпочтения в их представлениях. Эти предпочтения зависят от свойств признаков, таких как сложность, порядок обучения, распространенность в наборе данных и позиция в последовательности вывода. Представительные предпочтения могут относиться к неявным индуктивным предпочтениям в глубоком обучении. Практически эти предпочтения создают вызовы для интерпретации выученных представлений и их сравнения в различных системах машинного обучения, когнитивных науках и нейронауке.

Проверьте статью. Вся заслуга за это исследование принадлежит исследователям этого проекта. Также не забудьте подписаться на наш Twitter. Присоединяйтесь к нашему каналу в Telegram, каналу в Discord и группе в LinkedIn.

Если вам нравится наша работа, вам понравится наш информационный бюллетень.

Не забудьте присоединиться к нашему 43k+ ML SubReddit. Также посмотрите наш платформу AI Events.

Пост Индуктивные предпочтения в глубоком обучении: понимание представления признаков был опубликован на MarkTechPost.

Используйте ИИ для развития вашего бизнеса

Если вы хотите, чтобы ваша компания развивалась с помощью искусственного интеллекта (ИИ) и оставалась в числе лидеров, грамотно используйте Inductive Biases in Deep Learning: Understanding Feature Representation .

Проанализируйте, как ИИ может изменить вашу работу. Определите, где возможно применение автоматизации: найдите моменты, когда ваши клиенты могут извлечь выгоду из AI.

Определитесь какие ключевые показатели эффективности (KPI): вы хотите улучшить с помощью ИИ.

Подберите подходящее решение, сейчас очень много вариантов ИИ. Внедряйте ИИ решения постепенно: начните с малого проекта, анализируйте результаты и KPI.

На полученных данных и опыте расширяйте автоматизацию.

Если вам нужны советы по внедрению ИИ, пишите нам на https://t.me/itinai. Следите за новостями о ИИ в нашем Телеграм-канале t.me/itinainews или в Twitter @itinairu45358.

Попробуйте AI Sales Bot. Этот AI ассистент в продажах, помогает отвечать на вопросы клиентов, генерировать контент для отдела продаж, снижать нагрузку на первую линию.

Узнайте, как ИИ может изменить ваши процессы с решениями от AI Lab itinai.ru будущее уже здесь!

«`