«`html

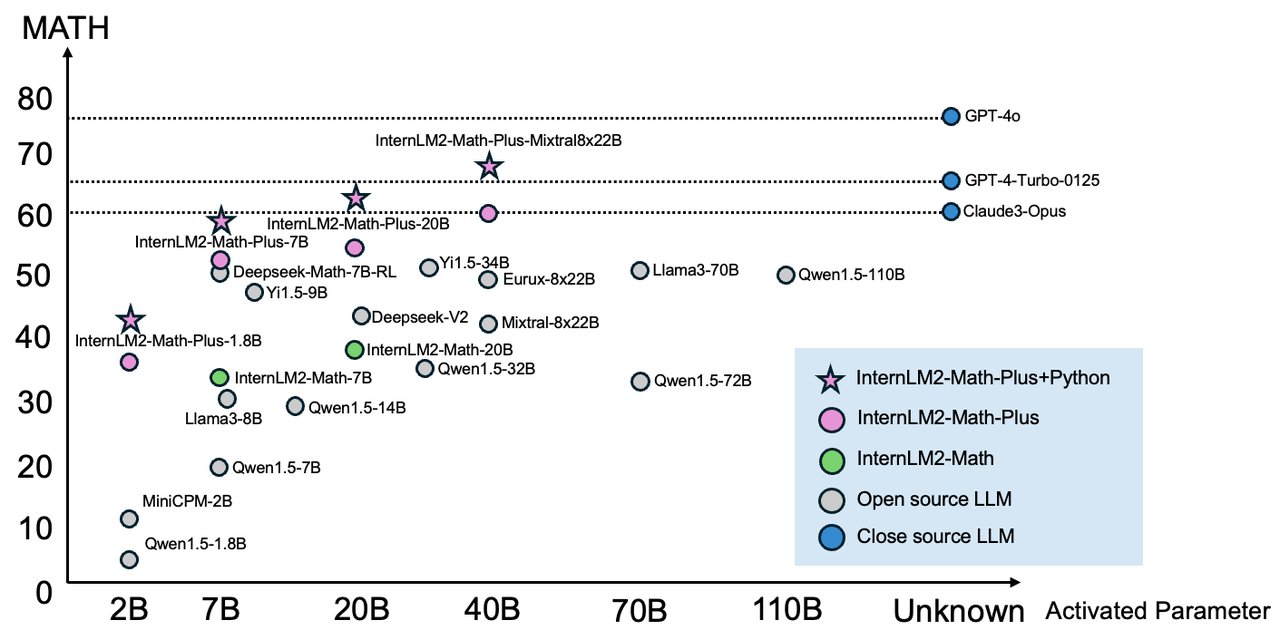

Исследовательская группа InternLM выпускает InternLM2-Math-Plus: серию математически ориентированных LLM размером 1,8 млрд, 7 млрд, 20 млрд и 8×22 млрд параметров с улучшенным цепочным мышлением, интерпретацией кода и LEAN 4 Reasoning

Команда исследователей InternLM занимается разработкой и усовершенствованием больших языковых моделей (LLM), специально предназначенных для математического рассуждения и решения проблем. Эти модели разработаны для улучшения возможностей искусственного интеллекта в решении сложных математических задач, включая формальные доказательства и неформальное решение проблем.

Практические решения и ценность:

Исследователи отмечают, что текущие модели искусственного интеллекта часто нуждаются в улучшении глубины и точности, необходимых для сложных математических вычислений и логических доказательств. Необходимость улучшения производительности математического рассуждения искусственным интеллектом критически важна, поскольку существующие модели нуждаются в помощи для достижения необходимой точности и эффективности для более сложных задач.

Традиционные методы обучения этих моделей включают в себя обширные наборы данных математических задач и решений. Техники, такие как цепочное мышление и программирование мышления, помогают моделировать пошаговые процессы людей для решения математических задач. Однако эти подходы часто требуют большей эффективности и точности для более сложных математических задач, подчеркивая необходимость инновационных решений.

Исследователи из Шанхайской лаборатории искусственного интеллекта, Университета Цинхуа, Университета Фудан, Университета Южной Калифорнии и Шанхайского Джаотунского университета представили InternLM2-Math-Plus. Эта серия моделей включает варианты с 1,8 млрд, 7 млрд, 20 млрд и 8×22 млрд параметрами, нацеленные на улучшение неформального и формального математического рассуждения через улучшенные методики обучения и наборы данных. Эти модели направлены на устранение разрыва в производительности и эффективности в решении сложных математических задач.

Четыре варианта InternLM2-Math-Plus, представленные исследовательской группой:

- InternLM2-Math-Plus 1.8B: Этот вариант фокусируется на обеспечении баланса между производительностью и эффективностью. Он был предварительно обучен и донастроен для обработки неформального и формального математического рассуждения, достигая показателей 37,0 по MATH, 41,5 по MATH-Python и 58,8 по GSM8K, превосходя другие модели своего размера.

- InternLM2-Math-Plus 7B: Разработанный для более сложных задач решения проблем, этот вариант значительно улучшает существующие модели с открытым исходным кодом. Он достигает 53,0 по MATH, 59,7 по MATH-Python и 85,8 по GSM8K, демонстрируя улучшенные возможности неформального и формального математического рассуждения.

- InternLM2-Math-Plus 20B: Этот вариант тянет границы производительности еще дальше, что делает его подходящим для высоко требовательных математических вычислений. Он достигает показателей 53,8 по MATH, 61,8 по MATH-Python и 87,7 по GSM8K, что указывает на его надежную производительность в различных тестовых испытаниях.

- InternLM2-Math-Plus Mixtral8x22B: Самый большой и мощный вариант, Mixtral8x22B, обеспечивает непревзойденную точность и точность. Он набирает 68,5 по MATH и впечатляющие 91,8 по GSM8K, что делает его предпочтительным выбором для наиболее сложных математических задач благодаря обширным параметрам и превосходной производительности.

Модели InternLM2-Math-Plus включают в себя такие продвинутые техники, как цепочное мышление, моделирование вознаграждения и интерпретатор кода. Модели предварительно обучаются на разнообразных высококачественных математических данных, включая синтетические данные для числовых операций и областно-специфические наборы данных. Дальнейшая донастройка через наблюдаемое обучение на отобранных наборах данных улучшает их способности в решении проблем и верификации.

Относительно производительности модели InternLM2-Math-Plus показывают заметное улучшение по сравнению с существующими моделями. Например, модель 1,8 млрд вариантов превосходит MiniCPM-2B в самой маленькой категории размера. Аналогично модель 7 млрд превосходит Deepseek-Math-7B-RL, ранее считавшиеся лучшими моделями математического рассуждения с открытым исходным кодом. Особенно стоит отметить, что самая большая модель, Mixtral8x22B, достигает высоких показателей по MATH и GSM8K, указывая на превосходные возможности в решении проблем.

Каждый вариант InternLM2-Math-Plus разработан для решения конкретных потребностей в математическом рассуждении. Модель 1,8 млрд обеспечивает баланс между производительностью и эффективностью, что идеально подходит для приложений, требующих надежных, но компактных моделей. Модель 7 млрд предоставляет улучшенные возможности для решения более сложных задач. Модель 20 млрд дальше улучшает производительность, что делает ее подходящей для высоко требовательных математических вычислений. Модель Mixtral8x22B с обширными параметрами обеспечивает непревзойденную точность и точность, что делает ее предпочтительным выбором для наиболее сложных математических задач.

В заключение, исследование InternLM2-Math-Plus свидетельствует о существенном продвижении в возможностях математического рассуждения LLM. Модели эффективно решают ключевые проблемы, интегрируя сложные техники обучения и использование обширных наборов данных, улучшая производительность на различных математических испытаниях.

Источники:

If you need advice on implementing AI, please contact us at t.me/itinai. Follow the latest AI news in our Telegram channel t.me/itinainews or on Twitter @itinairu45358.

Try AI Sales Bot itinai.ru/aisales. This AI sales assistant helps to answer customer questions, generate content for the sales department, and reduce the workload on the front line.

Learn how AI can change your processes with solutions from AI Lab itinai.ru — the future is already here!

«`