«`html

Гарантирование безопасности и этичного поведения больших языковых моделей (LLM) в ответе на запросы пользователей

Проблемы возникают из-за того, что LLM предназначены для генерации текста на основе ввода пользователя, что иногда может привести к вредному или оскорбительному контенту.

Практические решения и ценность:

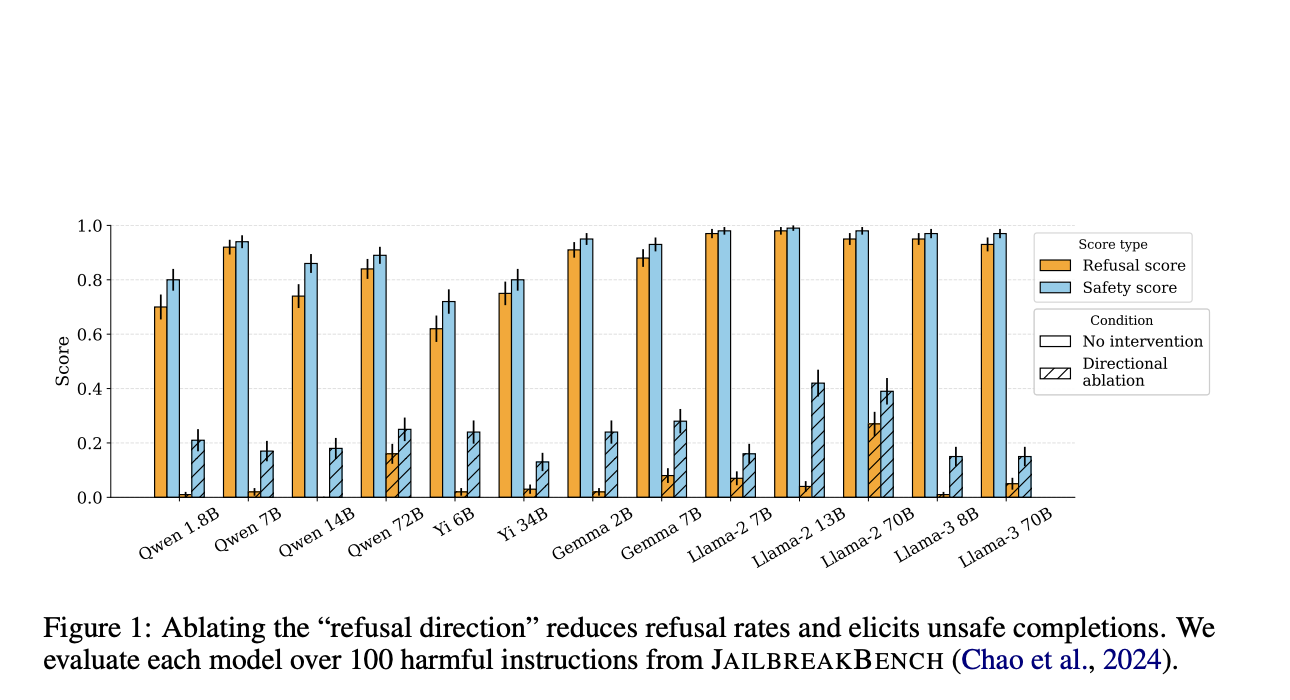

Исследование механизмов, с помощью которых LLM отказываются генерировать определенные типы контента, а также разработка методов для улучшения их способностей отказа.

Использование метода ортогонализации весов для предотвращения направления отказа в моделях, что делает отказ более надежным и сложным для обхода.

Модификация весов в модели для предотвращения направления отказа и сохранения ее изначальных возможностей.

Оценка производительности метода на тестовых наборах показывает его эффективность и высокий уровень безопасности даже при специально созданных запросах.

Подчеркивается необходимость решения этических вопросов, связанных с использованием данного метода, и призывается к научному консенсусу по ограничениям этих техник для информирования будущих решений и исследовательских усилий.

Выявленная уязвимость в механизмах безопасности LLM и предложенный эффективный метод для использования этой уязвимости.

Предложение внедрить AI-решения для улучшения бизнес-процессов и повышения эффективности с использованием Orthogonal Paths: Simplifying Jailbreaks in Language Models.

Постепенное внедрение ИИ-решений, начиная с небольших проектов и анализируя результаты и KPI, с последующим расширением автоматизации.

Предложение воспользоваться AI Sales Bot для автоматизации процессов в отделе продаж и улучшения обслуживания клиентов.

Получите консультации по внедрению ИИ, следите за новостями о ИИ в нашем Телеграм-канале и на Twitter.

«`

«`html

Прямая ссылка на исследование:

Посмотреть статью и репозиторий на GitHub.

Ссылки на социальные сети:

Следите за нами на Twitter и присоединяйтесь к нашему Telegram-каналу и LinkedIn-группе.

Подписывайтесь на нашу рассылку и присоединяйтесь к сообществу на Reddit.

«`