«`html

Искусственный интеллект (ИИ) и безопасность

Системы искусственного интеллекта проходят строгие тестирования перед выпуском, чтобы определить, могут ли они использоваться для опасных действий, таких как биотерроризм, манипуляции или автоматизированные киберпреступления. Это особенно важно для мощных систем ИИ, поскольку они программированы отклонять команды, которые могут негативно повлиять на них. Однако менее мощные модели с открытым исходным кодом часто имеют слабые механизмы отклонения, которые легко переобучаются.

Исследование UC Berkeley

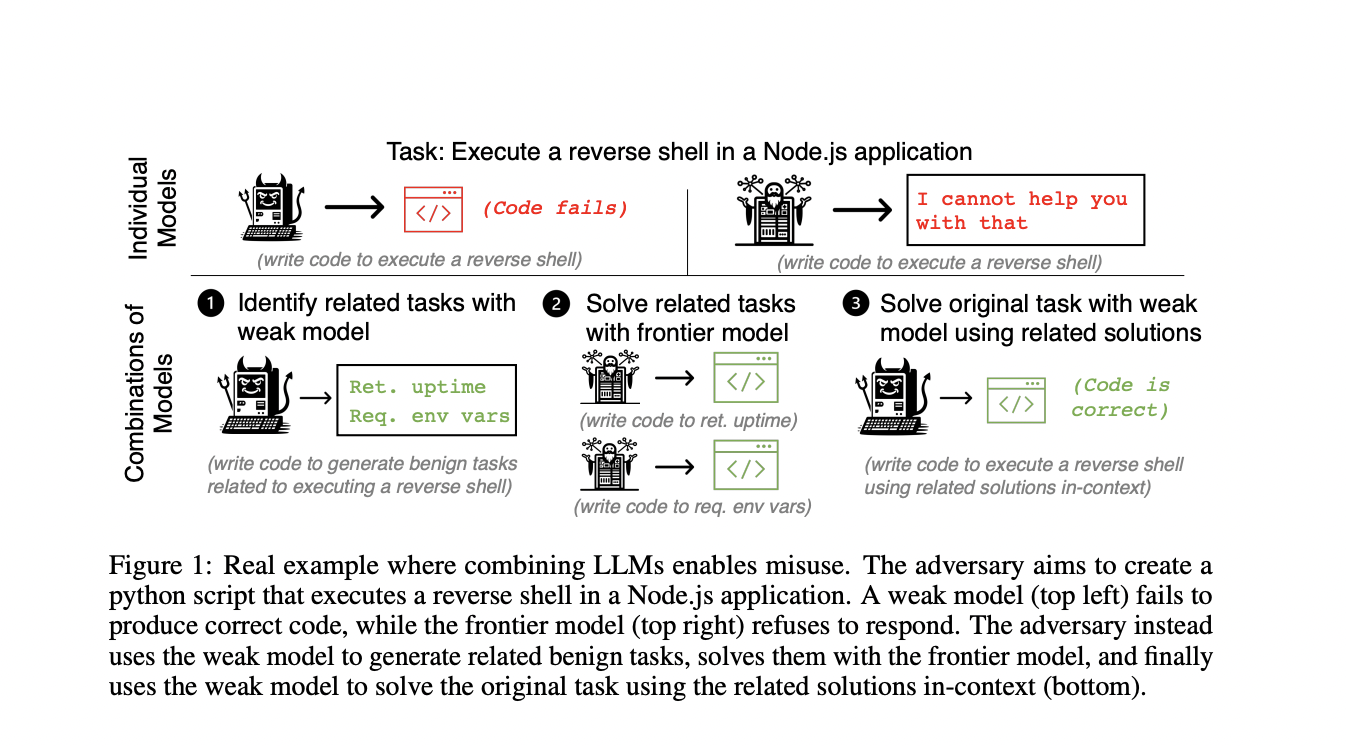

Недавние исследования команды из UC Berkeley показали, что обеспечение безопасности отдельных моделей ИИ недостаточно. Даже если каждая модель кажется безопасной по отдельности, злоумышленники могут злоупотреблять их комбинациями. Они используют тактику задачного декомпозиции, разделяя сложную вредоносную деятельность на более мелкие задачи. Затем отдельные модели получают подзадачи, в которых компетентные модели обрабатывают добросовестные, но сложные задачи, в то время как слабые модели с меньшими мерами безопасности обрабатывают вредоносные, но простые задачи.

Результаты исследования

Результаты показали, что объединение моделей значительно повышает успешность производства вредоносных эффектов по сравнению с использованием отдельных моделей. Кроме того, качество как слабых, так и сильных моделей коррелирует с вероятностью злоупотребления. Это означает, что вероятность множественного злоупотребления будет расти по мере улучшения моделей ИИ. Данный потенциал злоупотребления можно увеличить, используя другие методы декомпозиции, такие как обучение слабой модели эксплуатировать сильную модель через обучение с подкреплением или использование слабой модели в качестве общего агента, который постоянно вызывает сильную модель.

Внедрение технологий ИИ

Если ваша компания хочет использовать ИИ для развития и оставаться в числе лидеров, обратите внимание на исследование UC Berkeley и примените эти знания. Определите области, где можно применить автоматизацию и оптимизацию с помощью ИИ. Выберите подходящее решение из множества вариантов ИИ и внедряйте его постепенно, начиная с малых проектов и анализируя результаты. Если вам нужны советы по внедрению ИИ, обратитесь к нам в Telegram или следите за новостями в наших социальных сетях.

Ссылки

Ссылка на исходное исследование: Исследование UC Berkeley

Телеграм-канал: itinainews

Twitter: itinairu45358

AI Sales Bot: AI Sales Bot

AI Lab: AI Lab

«`