«`html

Регулирование искусственного интеллекта: обеспечение ответственности

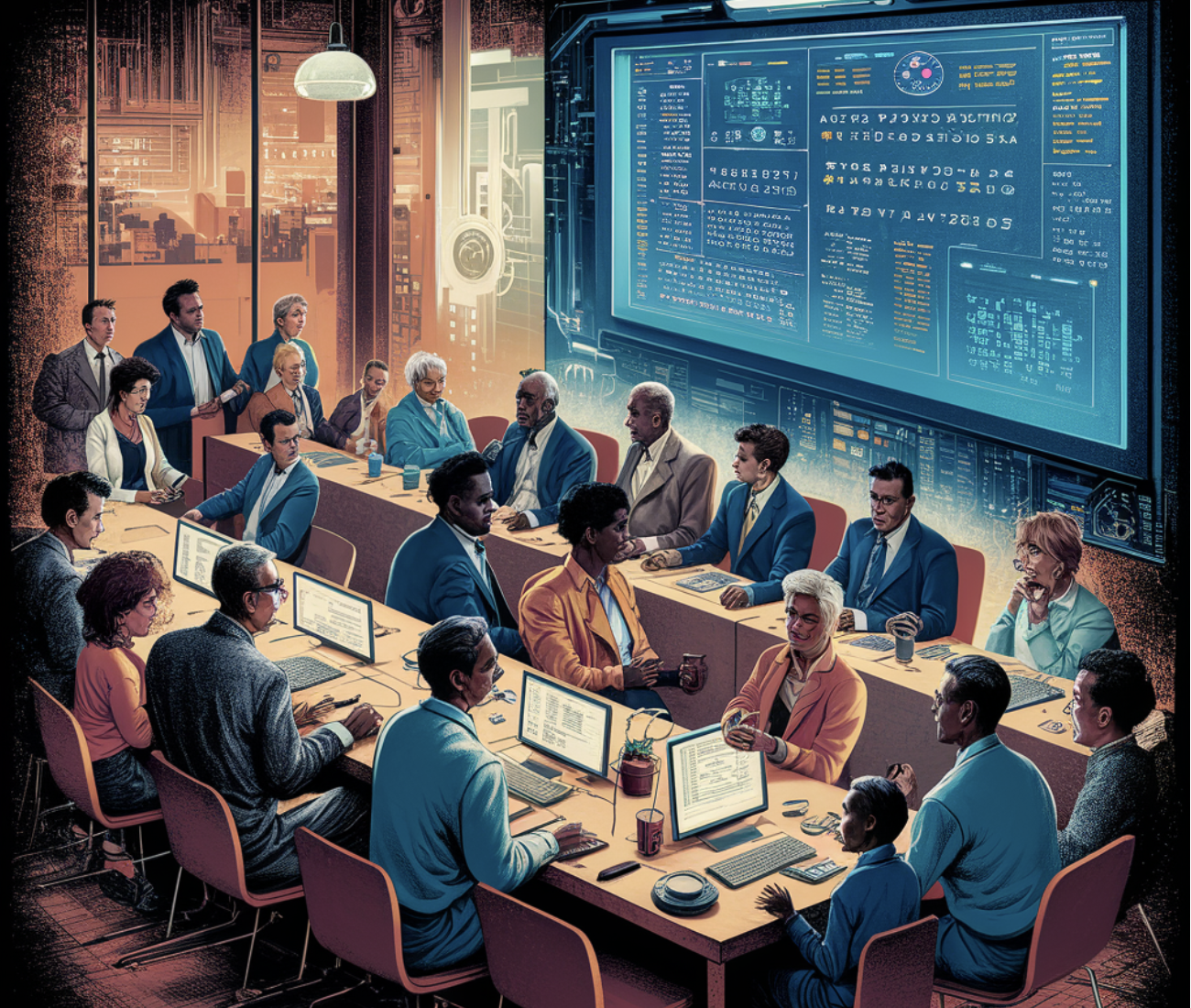

По мере того, как технологии искусственного интеллекта (ИИ) продолжают развиваться и проникать в различные сферы общества, возникают значительные вызовы для существующих правовых рамок. Одной из основных проблем является то, как законодательство должно регулировать субъекты, не обладающие намерениями. Традиционные правовые принципы часто опираются на концепцию mens rea, или умственного состояния деятеля, для определения ответственности в областях, таких как свобода слова, авторское право и уголовное право. Однако агенты ИИ, так как они существуют в настоящее время, не обладают намерениями таким же образом, как люди. Это создает потенциальную лазейку, через которую использование ИИ может быть избавлено от ответственности просто потому, что эти системы не обладают необходимым умственным состоянием.

Предложение использования объективных стандартов для регулирования ИИ

Новая статья из Юридической школы Йель, «Право ИИ — это право рискованных агентов без намерений», решает эту критическую проблему, предлагая использование объективных стандартов для регулирования ИИ. Эти стандарты черпаются из различных частей права, которые либо приписывают намерения деятелям, либо устанавливают для них объективные стандарты поведения. Основной аргумент заключается в том, что программы ИИ должны рассматриваться как инструменты, используемые людьми и организациями, делая этих людей и организации ответственными за действия ИИ. Статья предлагает переход к объективным стандартам для устранения этой проблемы. Автор аргументирует, что люди и организации, использующие ИИ, должны нести ответственность за причиненный вред, аналогично тому, как принципалы несут ответственность за своих агентов. Кроме того, подчеркивается наложение обязанностей разумной осторожности и снижения рисков на тех, кто разрабатывает, внедряет и использует технологии ИИ.

Практические применения

Статья также обсуждает два практических применения, в которых ИИ-программы должны регулироваться с использованием объективных стандартов: клевета и нарушение авторских прав. Она исследует, как объективные стандарты и разумное регулирование могут решить проблемы ответственности, возникающие из-за технологий ИИ.

Заключение

Эта исследовательская статья исследует правовую ответственность за технологии ИИ, используя принципы агентского права, приписываемые намерения и объективные стандарты. Обращаясь к действиям ИИ аналогично действиям человеческих агентов в рамках агентского права, мы подчеркиваем, что принципалы должны нести ответственность за действия своих ИИ-агентов, обеспечивая отсутствие снижения обязанности заботы.

Применение ИИ в вашем бизнесе

Если вы хотите использовать ИИ для развития своей компании, определите области, где автоматизация может приносить пользу вашим клиентам. Выберите ключевые показатели эффективности, которые вы хотите улучшить с помощью ИИ. Подберите подходящее решение и внедряйте его постепенно, начиная с небольших проектов и анализируя результаты.

Связь с нами

Если вам нужны советы по внедрению ИИ, пишите нам на https://t.me/itinai. Следите за новостями о ИИ в нашем Телеграм-канале t.me/itinainews или в Twitter @itinairu45358.

AI Sales Bot

Попробуйте AI Sales Bot. Этот ИИ-ассистент в продажах помогает отвечать на вопросы клиентов, генерировать контент для отдела продаж и снижать нагрузку на первую линию.

AI Lab

Узнайте, как ИИ может изменить ваши процессы с решениями от AI Lab itinai.ru. Будущее уже здесь!

«`