«`html

Революция в области искусственного интеллекта с помощью Mamba: обзор его возможностей и будущих направлений

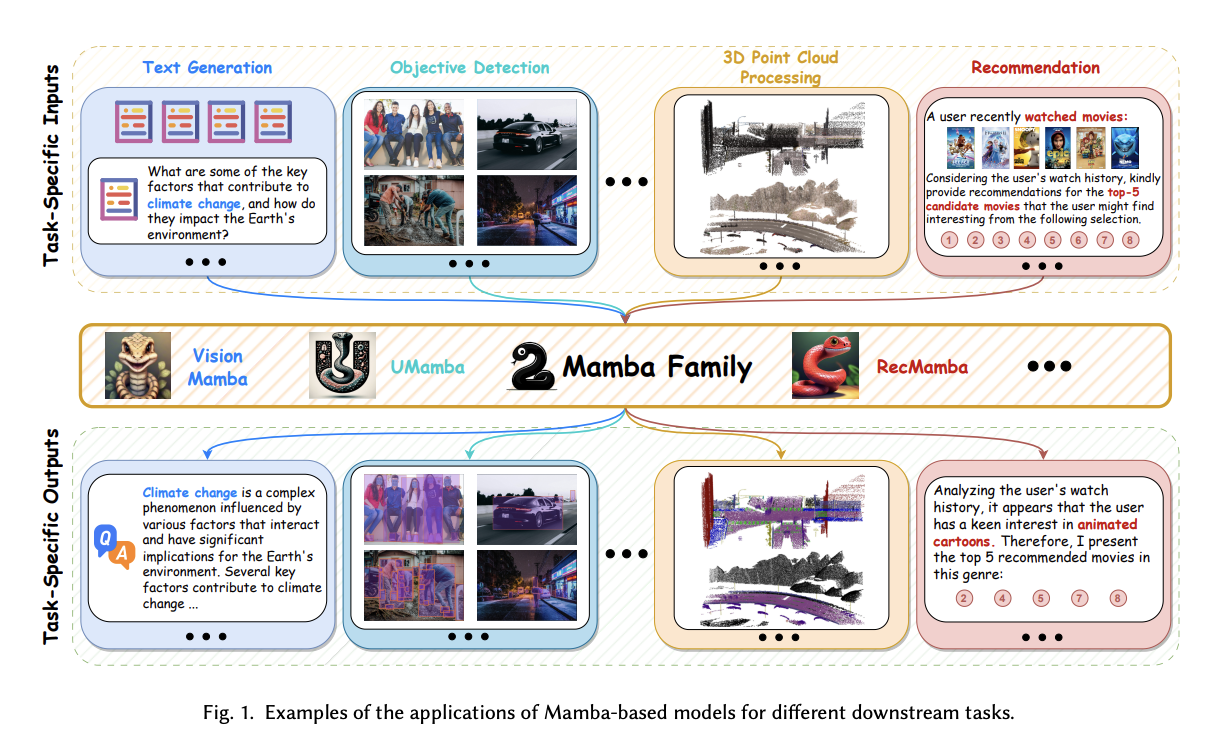

Глубокое обучение революционизировало различные области, и архитектура Transformers стала доминирующей. Однако для улучшения обработки длинных последовательностей необходимо улучшить работу Transformers из-за квадратичной вычислительной сложности. Недавно новая архитектура под названием Mamba показала потенциал в создании фундаментальных моделей с возможностями, сравнимыми с Transformers, сохраняя при этом практически линейную масштабируемость с длиной последовательности. Этот обзор направлен на всестороннее понимание этой новой модели путем систематизации существующих исследований, основанных на Mamba.

Уникальная архитектура Mamba и ее преимущества

Архитектура Mamba представляет собой уникальное сочетание концепций рекуррентных нейронных сетей (RNN), Transformers и моделей состояний. Этот гибридный подход позволяет Mamba использовать преимущества каждой архитектуры, минимизируя их недостатки. Особое внимание заслуживает инновационный механизм выбора в Mamba, который параметризует модель состояния на основе ввода, позволяя модели динамически настраивать свое внимание на актуальную информацию. Эта адаптивность критически важна для работы с различными типами данных и поддержания производительности в различных задачах.

Эффективность и перспективы применения

Производительность Mamba выделяется особым образом, демонстрируя замечательную эффективность. Она достигает ускорения вычислений до трех раз на графических процессорах A100 по сравнению с традиционными моделями Transformers. Это ускорение обусловлено ее способностью вычислять рекуррентно с помощью метода сканирования, что снижает накладные расходы, связанные с расчетами внимания. Более того, практически линейная масштабируемость Mamba означает, что с увеличением длины последовательности вычислительные затраты не растут экспоненциально. Эта особенность делает возможным обработку длинных последовательностей без препятствий в ресурсах, открывая новые возможности для развертывания моделей глубокого обучения в реальном времени.

Кроме того, архитектура Mamba продемонстрировала мощные возможности моделирования для сложных последовательных данных. Благодаря эффективному захвату долгосрочных зависимостей и управлению памятью через свой механизм выбора, Mamba может превзойти традиционные модели в задачах, требующих глубокого контекстного понимания. Это проявляется особенно ярко в приложениях, таких как генерация текста и обработка изображений, где сохранение контекста на протяжении длинных последовательностей имеет первостепенное значение. В результате Mamba выделяется как многообещающая фундаментальная модель, которая не только преодолевает ограничения Transformers, но и прокладывает путь для будущих достижений в приложениях глубокого обучения в различных областях.

Заключение и перспективы

Этот обзор всесторонне рассматривает недавние исследования, связанные с Mamba, охватывая прогресс в моделях, основанных на Mamba, методы адаптации Mamba к различным данным и области, где Mamba может превзойти другие модели. Мощные возможности моделирования Mamba для сложных и длинных последовательных данных, а также практически линейная масштабируемость делают ее многообещающей альтернативой Transformers. Обзор также обсуждает текущие ограничения и исследует перспективные направления исследований, чтобы обеспечить более глубокое понимание для будущих исследований. По мере развития Mamba, у нее есть большой потенциал для значительного влияния на различные области и для расширения границ глубокого обучения.

Проверьте статью. Вся заслуга за это исследование принадлежит исследователям этого проекта. Также не забудьте подписаться на наш Twitter и присоединиться к нашему Telegram-каналу и группе LinkedIn. Если вам нравится наша работа, вам понравится наш новостной бюллетень.

Не забудьте присоединиться к нашему 48k+ ML SubReddit.

Найдите предстоящие вебинары по ИИ здесь.

Arcee AI выпустила DistillKit: Open Source, простой в использовании инструмент для дистилляции моделей для создания эффективных малых языковых моделей.

Пост Revolutionizing AI with Mamba: A Survey of Its Capabilities and Future Directions впервые появился на MarkTechPost.

«`