«`html

Оценка знаний в LLMs: проблемы и решения

Проблемы с оценкой знаний в LLMs

Большие языковые модели (LLMs) вызывают опасения своей фактичности из-за производства недостоверной, галлюцинированной или устаревшей информации. Существующие методы оценки, такие как факт-чекинг и факт-QA, сталкиваются с проблемами в оценке фактичности сгенерированного контента и масштабировании данных для оценки. Также LLMs часто реагируют несогласованно на один и тот же факт в разных формах, что требует улучшения существующих методов оценки.

Решение: KGLENS

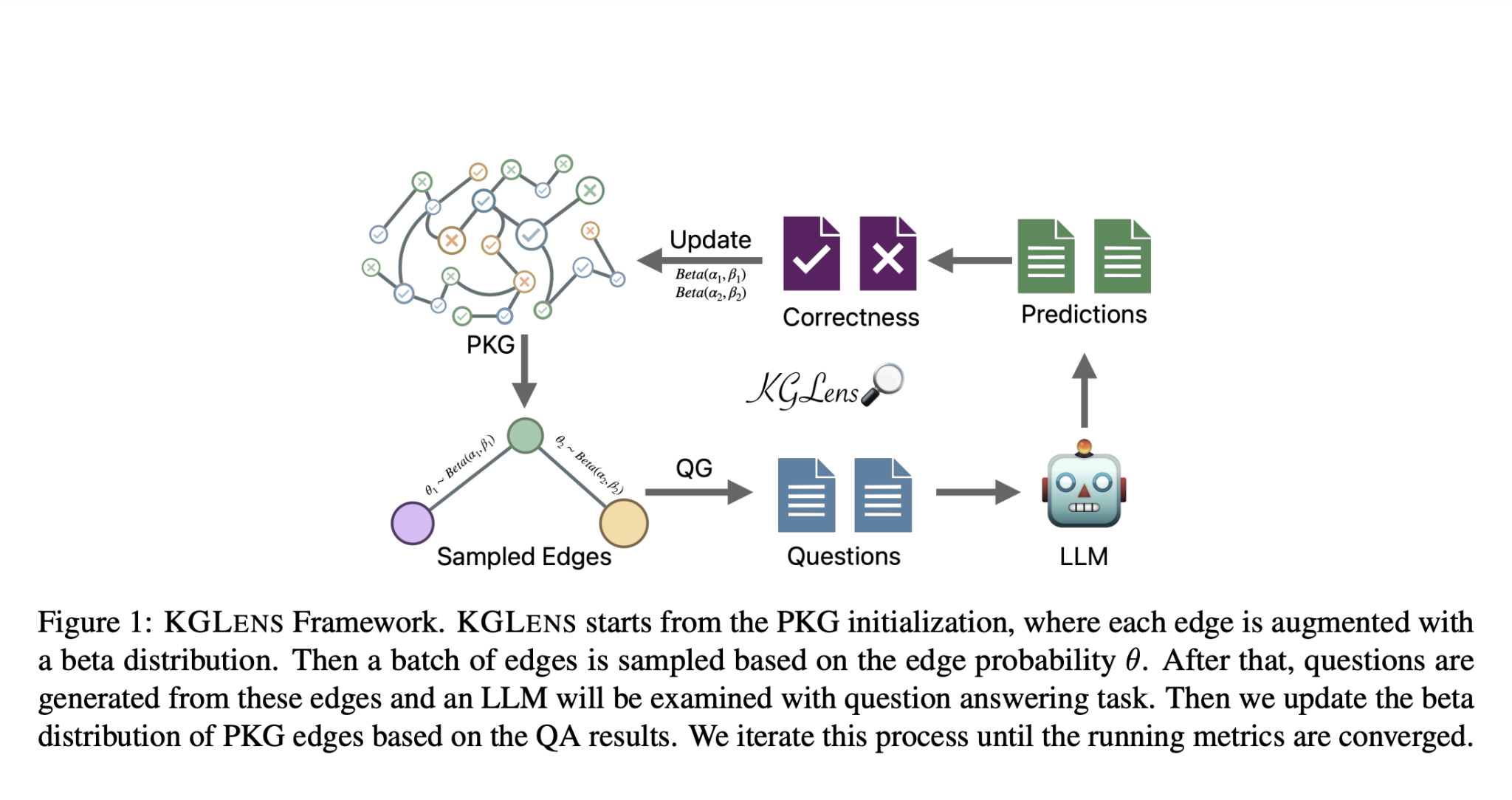

Исследователи из Apple представили KGLENS — инновационную систему оценки знаний, разработанную для измерения соответствия знаний между KGs и LLMs, а также выявления слепых зон знаний в LLMs. KGLENS использует уникальный подход для эффективной оценки знаний в LLMs с помощью параметризованного графа знаний (PKG) и метода, вдохновленного Thompson sampling. Система также предлагает генератор вопросов, преобразующий KGs в естественный язык с использованием GPT-4, что позволяет создавать два типа вопросов (факт-чекинг и факт-QA) для уменьшения неоднозначности ответов. KGLENS демонстрирует эффективность в выявлении слепых зон знаний в LLMs по различным темам и отношениям.

Значение для бизнеса

KGLENS представляет значительный прогресс в создании более точных и надежных приложений искусственного интеллекта. Это инструмент, способствующий развитию более надежных систем искусственного интеллекта, улучшению пользовательских впечатлений и повышению уровня знаний моделей. Оценка KGLENS показывает его эффективность и адаптивность в различных областях знаний, что делает его ценным инструментом для бизнеса.

Подробнее о работе можно узнать здесь.

Все права на исследование принадлежат исследователям проекта. Также не забудьте подписаться на наш Twitter и присоединиться к нашему каналу в Telegram и группе в LinkedIn. Если вам нравится наша работа, вам понравится и наш новостной бюллетень.

Не забудьте присоединиться к нашему сообществу в Reddit.

Узнайте о предстоящих вебинарах по искусственному интеллекту здесь.

Arcee AI выпустил DistillKit: открытый инструмент для моделирования, улучшающий дистилляцию моделей для создания эффективных малых языковых моделей. Подробнее.