Преимущества Генеративных Моделей на Основе Диффузионных Процессов в Искусственном Интеллекте

Проблемы и Решения

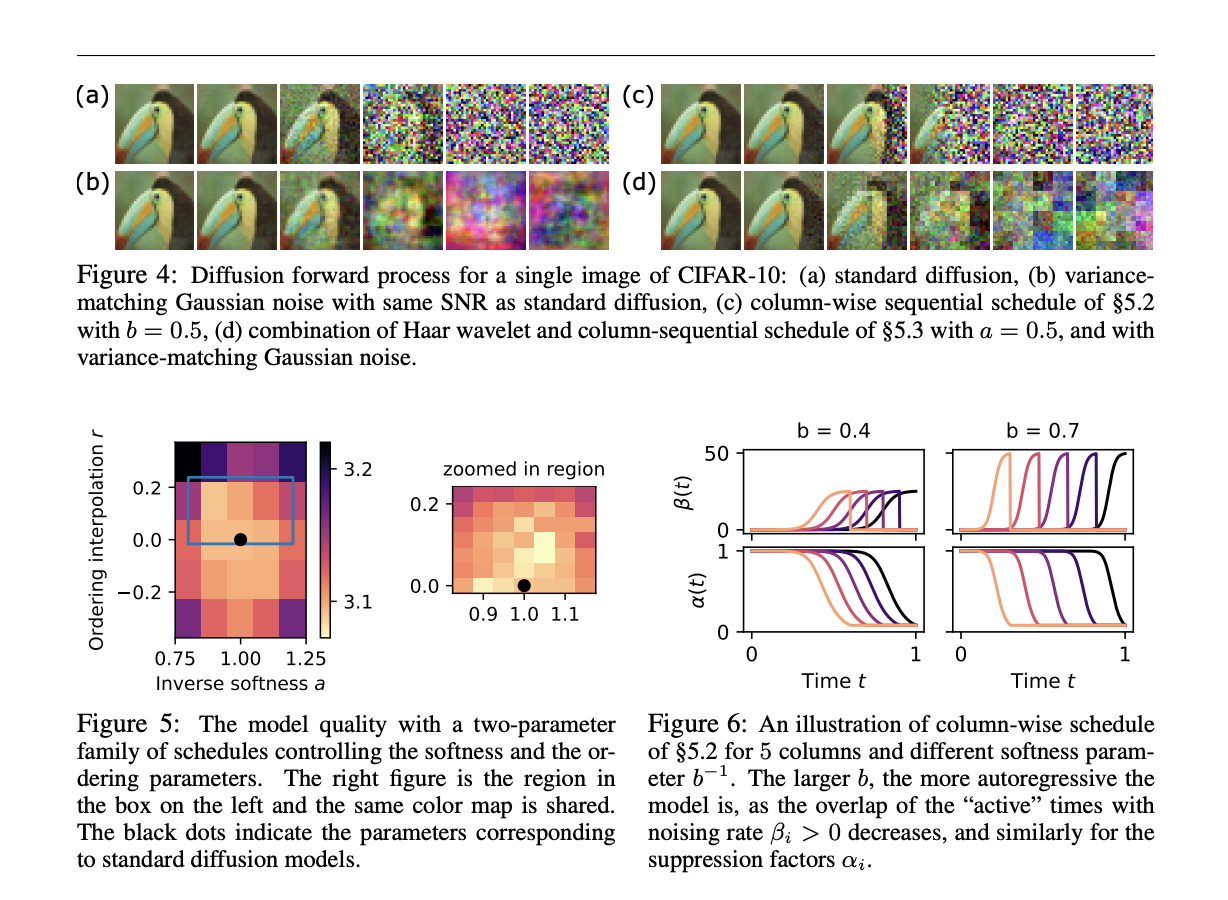

Генеративные модели на основе диффузионных процессов обещают преобразовывать шум в данные, но сталкиваются с ограничениями в гибкости и эффективности. Существующие модели диффузии обычно оперируют с фиксированными представлениями данных (например, на основе пикселей) и равномерными расписаниями шума, что ограничивает их способность адаптироваться к структуре сложных, высокоразмерных наборов данных. Эта жесткость приводит к неэффективности, делая модели вычислительно дорогостоящими и менее эффективными для задач, требующих тонкого контроля над генеративным процессом, таких как синтез изображений высокого разрешения и генерация иерархических данных.

Решение: Генеративное Объединенное Диффузионное (GUD) Пространство

Ученые из Университета Амстердама представили фреймворк Генеративного Объединенного Диффузионного (GUD), чтобы преодолеть ограничения традиционных моделей диффузии. Этот новаторский подход внедряет гибкость в выбор представления данных, разработку расписаний шума и интеграцию процессов диффузии и авторегрессии через мягкое условие. Позволяя диффузии происходить в различных базисах, таких как Фурье или PCA, модель может эффективно извлекать и генерировать признаки на разных масштабах. Введение расписаний шума для каждого компонента данных позволяет динамически регулировать уровни шума, а механизм мягкого условия улучшает фреймворк, объединяя диффузионные и авторегрессионные методы.

Практические Преимущества

Фреймворк GUD продемонстрировал превосходную производительность на различных наборах данных, значительно улучшая ключевые метрики, такие как отрицательное логарифмическое правдоподобие (NLL) и Fréchet Inception Distance (FID). Эксперименты на CIFAR-10 показали NLL 3.17 бит/разм, превосходя традиционные модели диффузии, которые обычно достигают более 3.5 бит/разм. Гибкость фреймворка GUD в регулировке расписаний шума привела к более реалистичной генерации изображений, что подтверждается более низкими показателями FID. Возможность переключения между авторегрессионными и диффузионными подходами через механизм мягкого условия дополнительно улучшила его генеративные возможности.