«`html

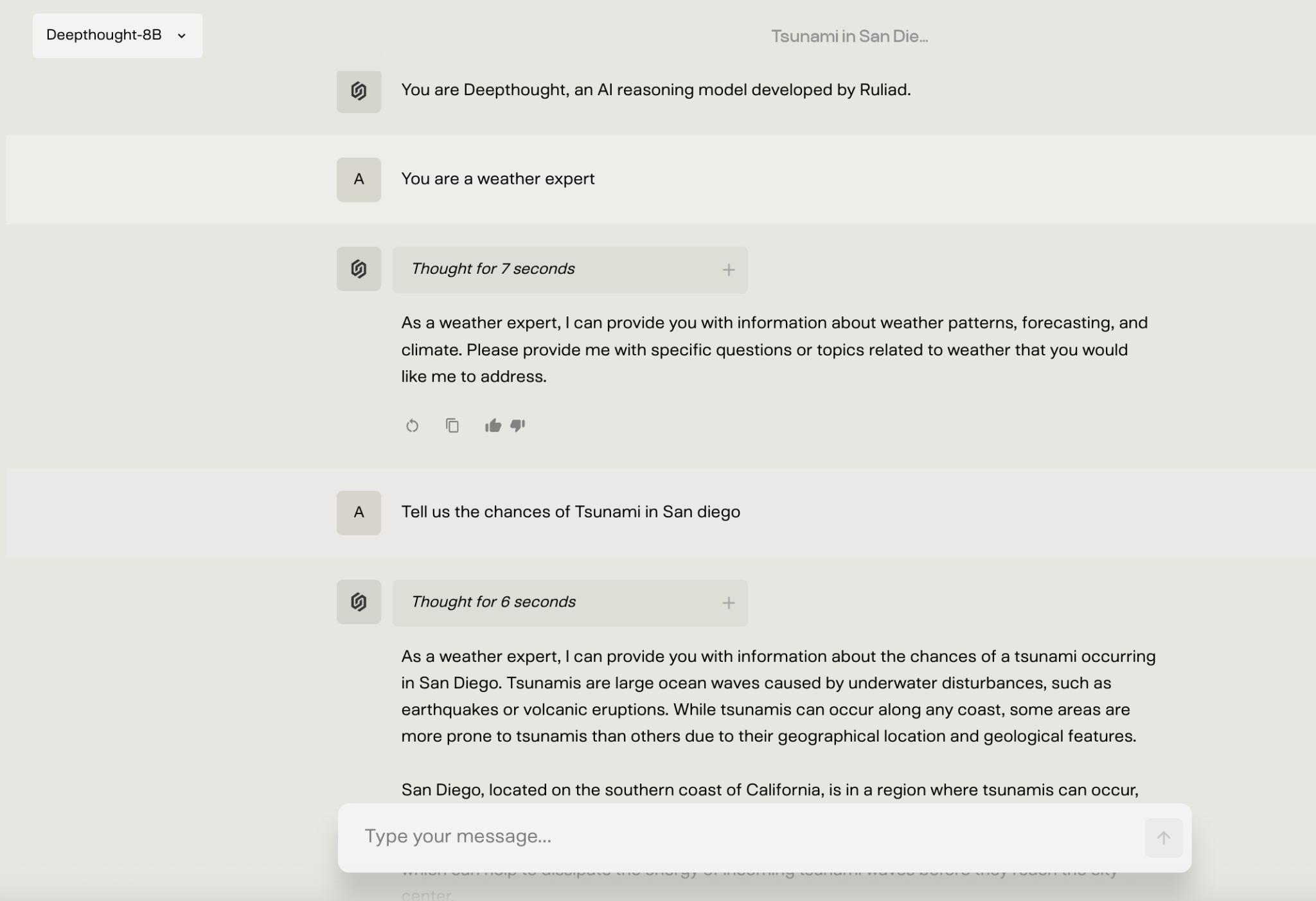

Ruliad AI представила Deepthought-8B

Deepthought-8B — это новая модель ИИ с 8 миллиардами параметров, созданная для прозрачного и контролируемого мышления. Она предлагает решения сложных задач, сопоставимые с более крупными моделями, при этом оставаясь эффективной в работе.

Ключевые особенности Deepthought-8B:

- Прозрачное мышление: Каждый шаг в процессе принятия решений документируется, что позволяет пользователям понимать логику модели.

- Программируемые шаблоны мышления: Модель можно настраивать под разные задачи без необходимости повторного обучения.

- Масштабируемость: Глубина мышления может изменяться в зависимости от сложности задач.

Эффективность и совместимость:

Deepthought-8B работает на системах с 16 ГБ или более видеопамяти и поддерживает современные технологии, такие как Flash Attention 2. Она совместима с популярными фреймворками, такими как Python и PyTorch, что облегчает разработку.

Структура мышления:

Каждая цепочка мышления включает этапы: понимание проблемы, сбор данных, анализ, расчет, проверка, выводы и реализация. Это делает модель полезной для областей, требующих строгих логических процессов.

Производительность и ограничения:

Модель показывает хорошие результаты в задачах программирования и математики, но имеет ограничения в сложном математическом мышлении и обработке длинных контекстов. Признание этих ограничений способствует доверию пользователей и конструктивной обратной связи.

Поддержка и документация:

Deepthought-8B предлагается как коммерческое решение с лицензированием и полным набором поддержки, включая социальные сети и электронную почту. Документация включает подробные инструкции по установке и использованию.

Установка и использование:

Для установки используйте:

pip install torch transformers

pip install flash-attnДля использования модели в коде на Python:

from transformers import AutoModelForCausalLM, AutoTokenizer

import torch

model_name = "ruliad/deepthought-8b-llama-v0.01-alpha"

tokenizer = AutoTokenizer.from_pretrained(model_name)

model = AutoModelForCausalLM.from_pretrained(model_name)Заключение:

Deepthought-8B с 8.03 миллиарда параметров сопоставима с более крупными моделями в задачах мышления. Она доступна для систем с 16 ГБ видеопамяти и позволяет пользователям адаптировать производительность под сложность задач.

Как ИИ может помочь вашей компании:

Анализируйте, как ИИ может изменить вашу работу. Определите, где возможно применение автоматизации, и какие ключевые показатели эффективности (KPI) вы хотите улучшить с помощью ИИ.

Выбирайте подходящие решения и внедряйте их постепенно. Начните с малого проекта, анализируйте результаты и расширяйте автоматизацию на основе полученных данных.

Если вам нужны советы по внедрению ИИ, пишите нам в Telegram. Следите за новостями о ИИ в нашем Телеграм-канале или в Twitter.

Попробуйте AI Sales Bot, который помогает отвечать на вопросы клиентов и генерировать контент для отдела продаж. Узнайте, как ИИ может изменить ваши процессы с решениями от AI Lab.

«`