«`html

AnswerAI представляет модель answerai-colbert-small-v1

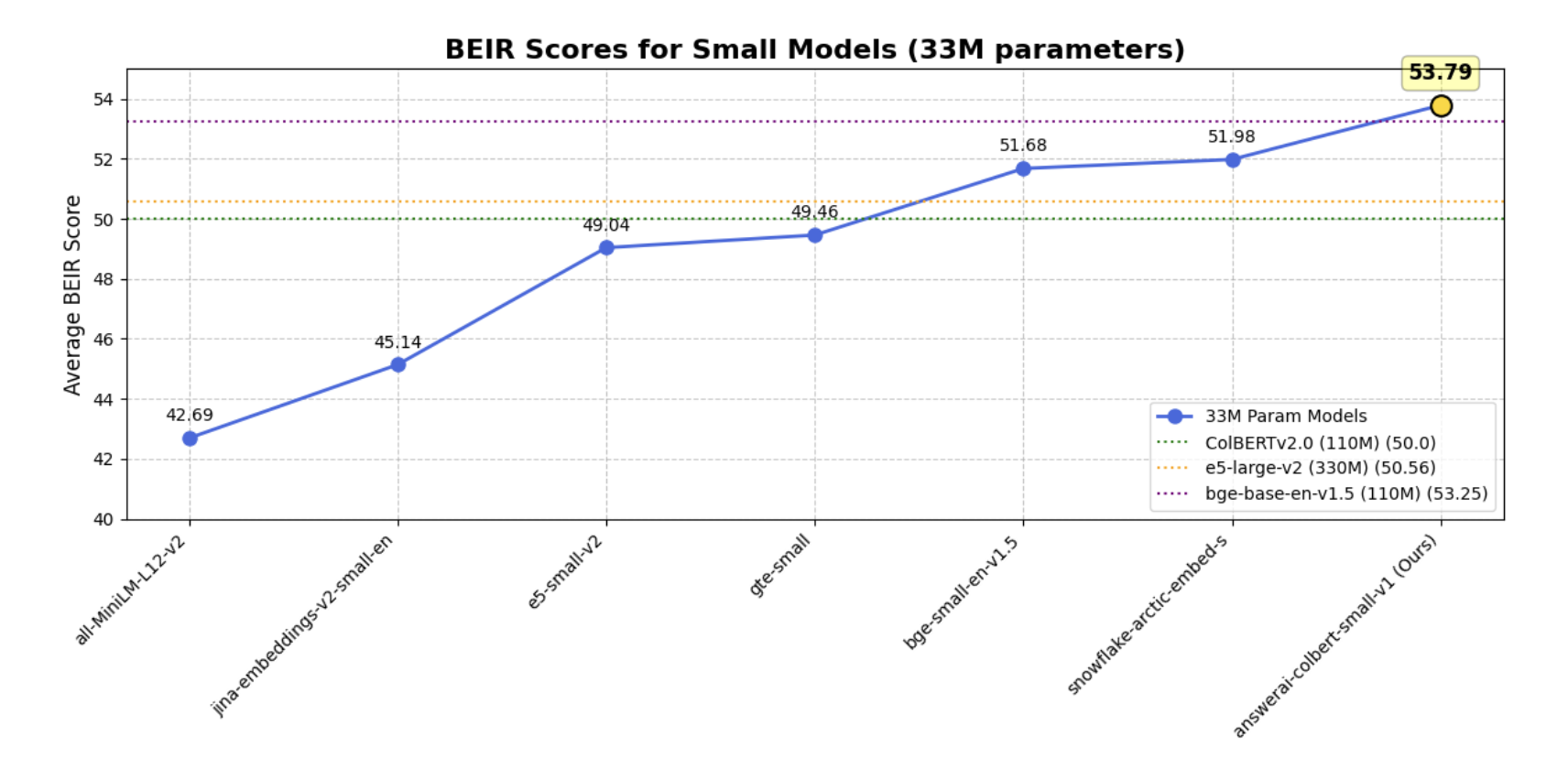

AnswerAI представил мощную модель под названием answerai-colbert-small-v1, демонстрируя потенциал мультивекторных моделей при их сочетании с передовыми методами обучения. Этот концепт модели, разработанный с использованием инновационного рецепта обучения JaColBERTv2.5 и дополнительных оптимизаций, продемонстрировал выдающуюся производительность, несмотря на свой компактный размер всего 33 миллиона параметров. Эффективность модели особенно заметна, поскольку она достигает этих результатов, сохраняя при этом размер, сопоставимый с MiniLM.

Превосходство модели answerai-colbert-small-v1

Модель answerai-colbert-small-v1 превзошла производительность всех предыдущих моделей схожего размера на общих бенчмарках. Более того, она превзошла гораздо более крупные и широко используемые модели, включая e5-large-v2 и bge-base-en-v1.5. Этот успех подчеркивает потенциал подхода AnswerAI в расширении границ возможностей с помощью более маленьких и эффективных моделей искусственного интеллекта.

Практическое применение модели

Мультивекторные ретриеверы, представленные архитектурой модели ColBERT, предлагают уникальный подход к представлению документов. В отличие от традиционных методов, создающих один вектор на документ, ColBERT генерирует несколько более мелких векторов, каждый из которых представляет отдельный токен. Эта техника решает проблему потери информации, часто связанную с одним вектором, особенно в задачах обобщения вне области применения. Архитектура также включает улучшение запроса с использованием маскированного языкового моделирования для улучшения производительности поиска.

Инновационный механизм оценки MaxSim ColBERT вычисляет сходство между токенами запроса и документа, суммируя наивысшие сходства для каждого токена запроса. Хотя этот подход последовательно улучшает обобщение вне области применения, изначально он сталкивался с проблемами в задачах внутри области применения и требовал значительных ресурсов памяти и хранения. ColBERTv2 решил эти проблемы, внедрив более современный рецепт обучения, включая отрицательные примеры внутри пакета и дистилляцию знаний, а также уникальный подход к индексации, который сократил требования к хранению.

В японском языковом контексте JaColBERTv1 и v2 продемонстрировали еще больший успех, чем их англоязычные аналоги. JaColBERTv1, следуя оригинальному рецепту обучения ColBERT, стал самым сильным монолингвальным японским ретриевером своего времени. JaColBERTv2, построенный на рецепте ColBERTv2, дальше улучшил производительность и в настоящее время является самым сильным ретриевером вне области применения среди всех существующих японских бенчмарков, хотя он все еще сталкивается с некоторыми проблемами в задачах крупномасштабного поиска, таких как MIRACL.

Будущая совместимость и внедрение модели

Модель answerai-colbert-small-v1 была специально разработана с учетом будущей совместимости, особенно с предстоящим обновлением RAGatouille. Такой перспективный подход гарантирует, что модель останется актуальной и полезной при появлении новых технологий. Несмотря на свою ориентированность на будущее, модель остается совместимой с последними реализациями ColBERT, предлагая пользователям гибкость в выборе инструментов и фреймворков.

Возможности применения модели

Для тех, кто заинтересован в использовании этой инновационной модели, доступны два основных варианта. Пользователи могут выбрать библиотеку Stanford ColBERT, которая является хорошо установленной и широко используемой реализацией. В качестве альтернативы они могут выбрать RAGatouille, которая может предложить дополнительные функции или оптимизации. Процесс установки любой из этих библиотек прост и требует всего лишь выполнения простой команды для начала работы.

Источник изображения: https://huggingface.co/answerdotai/answerai-colbert-small-v1

Результаты модели answerai-colbert-small-v1 демонстрируют ее исключительную производительность по сравнению с одновекторными моделями.

Источник изображения: https://huggingface.co/answerdotai/answerai-colbert-small-v1

Заключение

Модель answerai-colbert-small-v1 от AnswerAI представляет собой значительный прорыв в системах мультивекторного поиска. Несмотря на свои компактные 33 миллиона параметров, она превосходит более крупные модели, такие как e5-large-v2 и bge-base-en-v1.5. Построенная на архитектуре ColBERT и улучшенная рецептом обучения JaColBERTv2.5, она блестяще проявляет себя в задачах обобщения вне области применения. Успех модели обусловлен ее мультивекторным подходом, улучшением запроса и механизмом оценки MaxSim. Спроектированная с учетом будущей совместимости, особенно с предстоящим обновлением RAGatouille, она остается совместимой с последними реализациями ColBERT, предоставляя пользователям возможность легко внедрять ее с использованием библиотеки Stanford ColBERT или RAGatouille, демонстрируя потенциал AnswerAI в изменении эффективности и производительности искусственного интеллекта.

Проверьте карточку модели и детали. Вся заслуга за это исследование принадлежит исследователям этого проекта. Также не забудьте подписаться на наш Twitter и присоединиться к нашему каналу в Telegram и группе в LinkedIn. Если вам нравится наша работа, вам понравится наш newsletter.

Не забудьте присоединиться к нашему сообществу в Reddit.

Находите предстоящие вебинары по искусственному интеллекту здесь.

Arcee AI представляет Arcee Swarm: революционное смешение агентов MoA, вдохновленное кооперативным интеллектом, найденным в самой природе.