«`html

Решения для языковых моделей: практические рекомендации и ценность

Языковые модели (LMs) в обработке естественного языка (NLP)

Языковые модели (LMs) стали фундаментальными в обработке естественного языка (NLP), позволяя генерацию текста, перевод и анализ тональности. Однако для точной и эффективной работы эти модели требуют обширных объемов обучающих данных. Качество и подготовка этих наборов данных имеют решающее значение для производительности LMs.

Критическое значение качества обучающих наборов данных

Создание высококачественных наборов данных является сложной задачей, которая включает фильтрацию нерелевантного или вредного контента, удаление дубликатов и выбор наиболее полезных источников данных.

Проблемы существующих методов курирования данных

Существующие методы курирования данных обычно включают фильтрацию на основе эвристик, удаление дубликатов и сбор данных из обширных веб-краулов. Однако недостаточная стандартизация оценки производительности языковых моделей затрудняет понимание наиболее эффективных стратегий курирования данных.

Решения с открытым исходным кодом для улучшения LMs

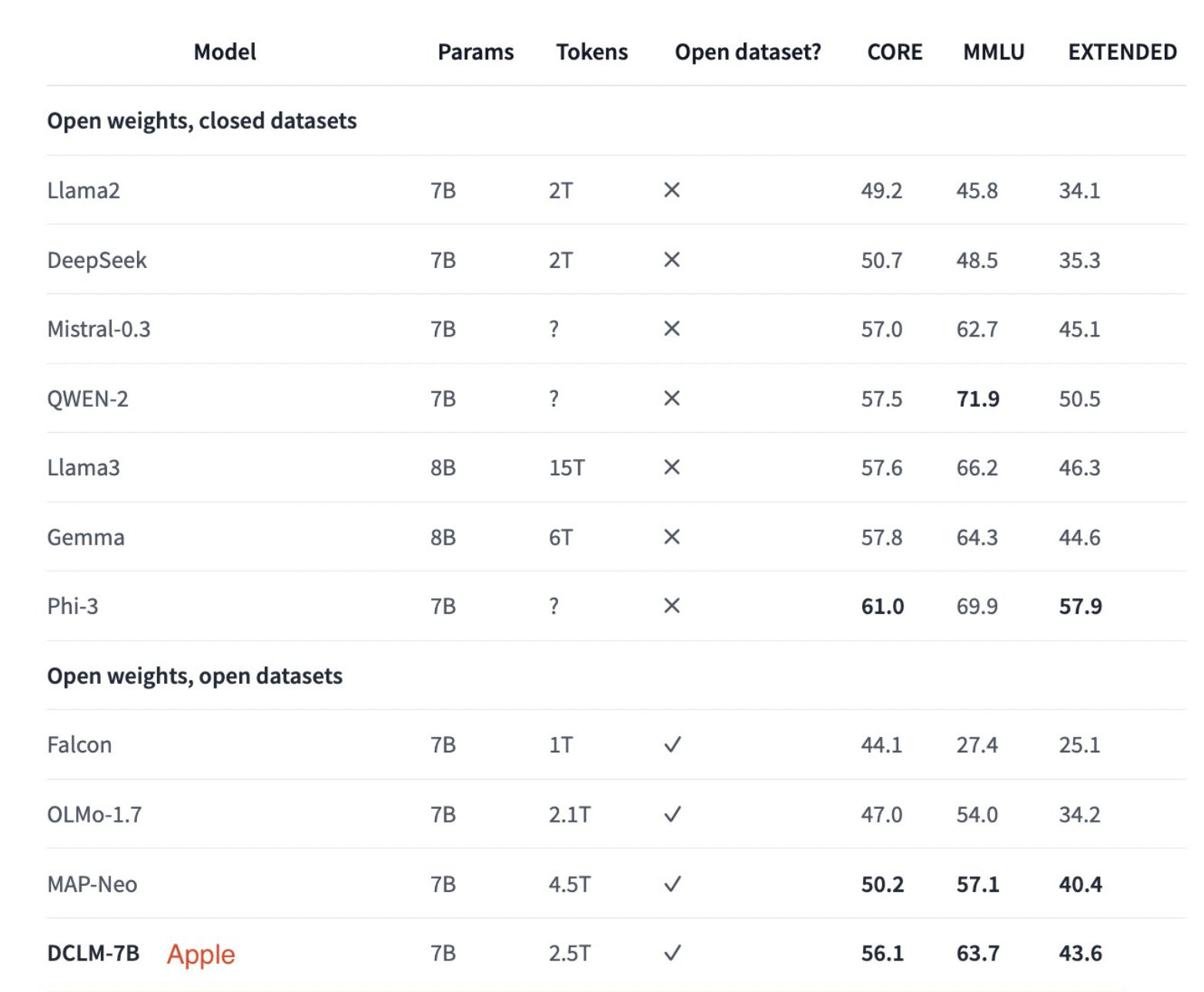

Исследователи из Apple, Университета Вашингтона и других институтов представили DataComp for Language Models (DCLM) для решения этих проблем. Они недавно открыли исходный код моделей и наборов данных DCIM на платформе Hugging Face. DCLM позволяет проводить контролируемые эксперименты с обширными наборами данных для улучшения языковых моделей.

Структурированный рабочий процесс и подход

Фреймворк DCLM предлагает структурированный рабочий процесс для исследователей, позволяя выбирать масштабы от 412M до 7B параметров и экспериментировать со стратегиями курирования данных. После этого производится оценка производительности моделей на серии задач, что помогает определить наиболее эффективные стратегии курирования данных.

Практические результаты и значимость DCLM

Внедрение DCLM привело к значительным улучшениям в обучении языковых моделей, позволяя достичь высокой точности при использовании меньше вычислительных ресурсов. Также подтверждена масштабируемость фреймворка DCLM и его эффективность в различных масштабах.

Поддержка и дополнительные решения

Если вам нужны советы по внедрению ИИ, пишите нам на https://t.me/itinai. Следите за новостями о ИИ в нашем Телеграм-канале t.me/itinainews или в Twitter @itinairu45358.

Попробуйте AI Sales Bot https://itinai.ru/aisales. Этот AI ассистент в продажах помогает отвечать на вопросы клиентов, генерировать контент для отдела продаж и снижать нагрузку на первую линию. Узнайте, как ИИ может изменить ваши процессы с решениями от AI Lab itinai.ru. Будущее уже здесь!