«`html

Arcee AI выпустила DistillKit: инновационный инструмент для создания эффективных малых языковых моделей

Arcee AI объявила о выпуске DistillKit, инновационного инструмента с открытым исходным кодом, разработанного для революционизации создания и распространения малых языковых моделей (SLM). Этот релиз соответствует постоянной миссии Arcee AI сделать ИИ более доступным и эффективным для исследователей, пользователей и бизнеса, стремящихся получить доступ к инструментам дистилляции с открытым исходным кодом и простым в использовании.

Введение в DistillKit

DistillKit — это передовой проект с открытым исходным кодом, ориентированный на дистилляцию моделей, процесс, позволяющий передавать знания от крупных, ресурсоемких моделей к более маленьким и эффективным. Этот инструмент направлен на то, чтобы сделать передовые возможности ИИ доступными для более широкой аудитории путем значительного снижения вычислительных ресурсов, необходимых для запуска этих моделей.

Методы дистилляции в DistillKit

DistillKit использует два основных метода передачи знаний: дистилляцию на основе логитов и дистилляцию на основе скрытых состояний.

Основные выводы DistillKit

Эксперименты и оценки производительности DistillKit предоставляют несколько ключевых идей относительно его эффективности и потенциальных применений:

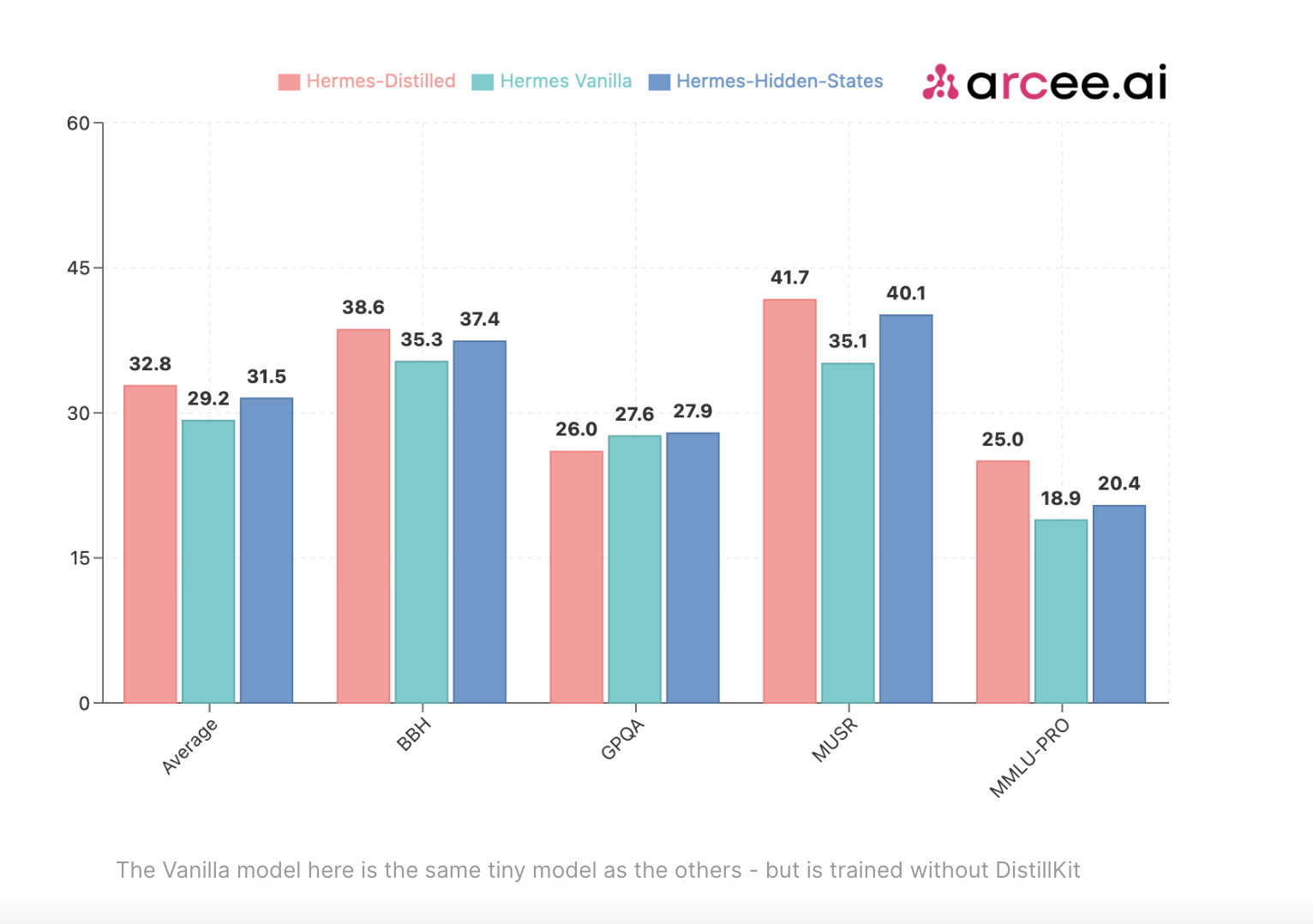

Результаты производительности

Эффективность DistillKit была тщательно протестирована через серию экспериментов для оценки ее влияния на производительность и эффективность моделей. Эти эксперименты фокусировались на различных аспектах, включая сравнение методов дистилляции, производительность дистиллированных моделей по сравнению с их учителями и применение дистилляции в специфических областях.

Влияние и будущие направления

Выпуск DistillKit призван обеспечить создание более малых, эффективных моделей для доступа к передовому ИИ различными пользователями и приложениями. Это критически важно для бизнеса и отдельных лиц, которые могут не иметь ресурсов для развертывания масштабных моделей ИИ. Модели, созданные с помощью DistillKit, предлагают несколько преимуществ, включая снижение энергопотребления и операционных расходов.

Заключение

DistillKit от Arcee AI является значительным достижением в области дистилляции моделей, предлагая надежный, гибкий и эффективный инструмент для создания SLM. Результаты производительности и ключевые выводы экспериментов подчеркивают потенциал DistillKit для революционизации развертывания ИИ, делая передовые модели более доступными и практичными.

Arcee AI приглашает сообщество принять участие в проекте, разрабатывая новые методы дистилляции для улучшения процессов обучения и оптимизации использования памяти.

«`