«`html

Эффективное обучение больших языковых моделей с помощью SALT

Большие языковые модели (БЯМ) лежат в основе многих приложений, от разговорных агентов до автоматизации создания контента. Однако их разработка связана с высокими вычислительными затратами на обучение.

Практические решения и ценность

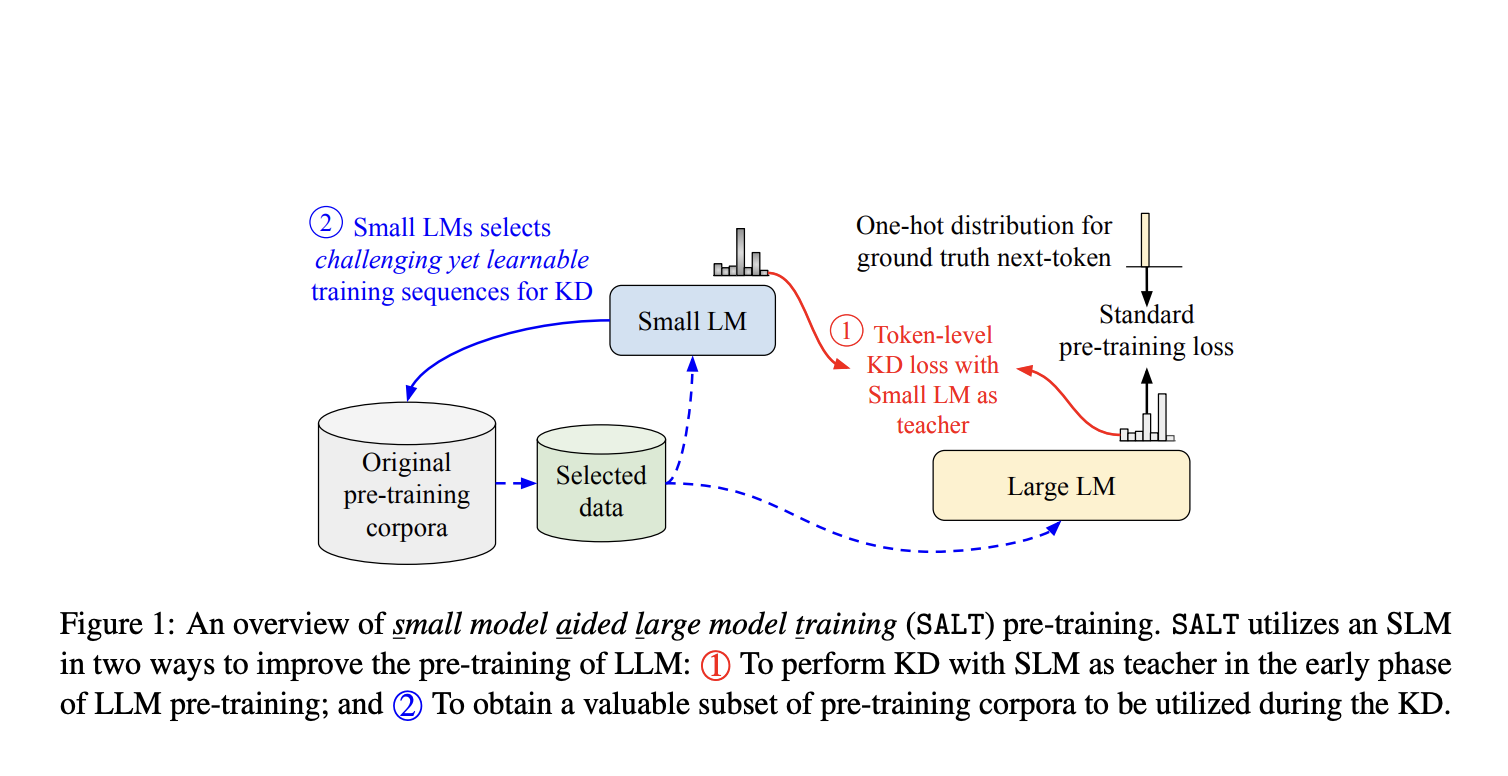

Метод SALT (Small model Aided Large model Training) предлагает инновационный подход к обучению БЯМ, используя менее мощные модели для повышения эффективности. Вот основные преимущества:

- Снижение вычислительных затрат: SALT уменьшает затраты на обучение БЯМ почти на 28%.

- Повышение качества: Модели, обученные с использованием SALT, показывают лучшие результаты в задачах, таких как резюмирование и логическое рассуждение.

- Фокус на важной информации: Меньшие модели помогают выбирать трудные, но обучаемые данные, что ускоряет процесс обучения.

- Доступность: Метод особенно полезен для организаций с ограниченными вычислительными ресурсами.

Двухфазный процесс SALT

SALT включает два этапа:

- На первом этапе меньшие модели выступают в роли «учителей», передавая свои прогнозы большим моделям.

- На втором этапе модели обучаются самостоятельно, что позволяет им лучше справляться с более сложными данными.

Рекомендации по внедрению ИИ

- Определите, как ИИ может улучшить вашу работу.

- Выберите ключевые показатели эффективности (KPI), которые вы хотите улучшить с помощью ИИ.

- Начните с небольшого проекта, анализируйте результаты и постепенно расширяйте автоматизацию.

Если вам нужны советы по внедрению ИИ, свяжитесь с нами через наш Telegram-канал. Следите за новостями об ИИ и узнайте, как он может изменить ваши процессы.

«`