«`html

YuLan-Mini: Эффективная языковая модель с открытыми данными

Большие языковые модели (LLMs), основанные на трансформерах, требуют предварительного обучения на больших объемах данных. Этот процесс требует мощной вычислительной инфраструктуры и хорошо организованных конвейеров данных. Растущий интерес к доступным LLM побуждает исследователей искать способы оптимизации ресурсов и производительности.

Проблемы разработки LLM

Создание LLM связано с многими вызовами, особенно в области вычислительных ресурсов и эффективности данных. Модели с миллиардами параметров требуют сложных технологий и значительных вложений. Качество данных и методы обучения имеют решающее значение, так как модели могут сталкиваться с нестабильностью градиента и ухудшением производительности. Открытые LLM часто уступают по качеству собственным моделям из-за ограниченного доступа к вычислительным мощностям и высококачественным наборам данных.

Успех YuLan-Mini

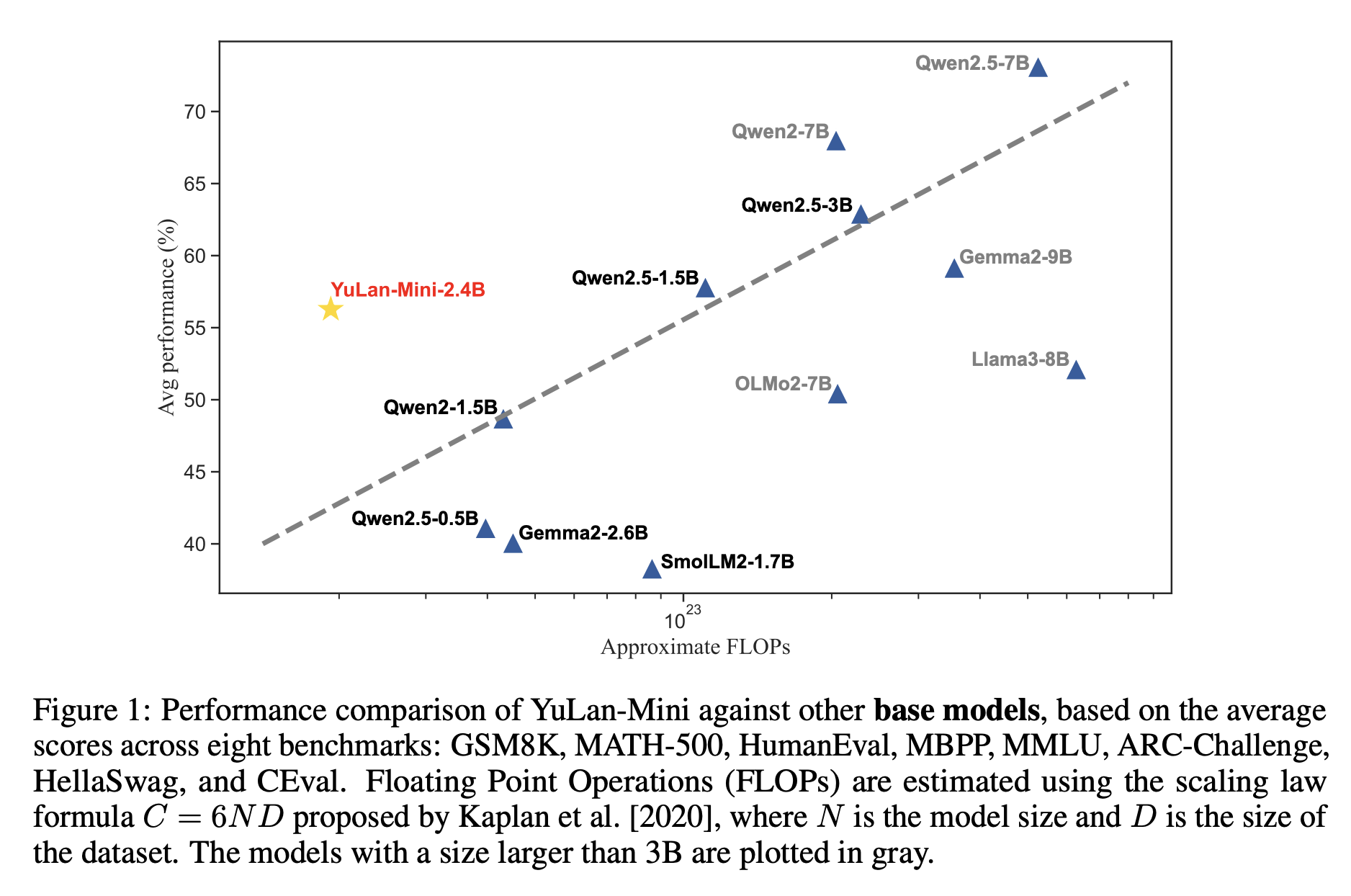

Исследователи из Гаолинской школы искусственного интеллекта разработали YuLan-Mini. Эта языковая модель с 2.42 миллиарда параметров улучшает вычислительную эффективность с помощью методов, ориентированных на данные. Используя общедоступные данные, YuLan-Mini демонстрирует выдающиеся результаты, сравнимые с более крупными промышленными моделями.

Инновации и эффективность

Архитектура YuLan-Mini включает несколько инновационных элементов. Ее трансформерный дизайн улучшает стабильность обучения и уменьшает размер параметров. Использование Rotary Positional Embedding (ROPE) позволяет эффективно обрабатывать длинные контексты. Модель имеет улучшенные функции активации и стратегию аннулирования для стабилизации обучения.

Результаты и достижения

YuLan-Mini показала высокие результаты: 64.00 на HumanEval, 37.80 на MATH-500 и 49.10 на MMLU. Эти результаты подчеркивают конкурентные преимущества модели, так как она демонстрирует высокую точность при работе с длинными текстами и короткими задачами.

Ключевые выводы

- Эффективные конвейеры данных уменьшают зависимость от больших наборов данных.

- Оптимизация и аннулирование предотвращают проблемы, такие как резкие колебания потерь.

- Увеличение длины контекста до 28,672 токенов улучшает применение модели для сложных задач.

- Несмотря на скромные вычислительные требования, YuLan-Mini показывает результаты, сопоставимые с более крупными моделями.

- Интеграция синтетических данных улучшает результаты обучения и снижает потребность в собственных наборах данных.

Как использовать AI в вашем бизнесе

Чтобы ваша компания развивалась с помощью ИИ, рассмотрите использование YuLan-Mini. Проанализируйте, как ИИ может изменить вашу работу, определите области для автоматизации и ключевые показатели эффективности (KPI), которые вы хотите улучшить.

Выберите подходящее решение ИИ, начните с малого проекта, анализируйте результаты и KPI, и на основе полученных данных расширяйте автоматизацию.

Если вам нужны советы по внедрению ИИ, пишите нам в Телеграм. Следите за новостями о ИИ в нашем канале или в Twitter.

Попробуйте AI Sales Bot, который поможет вам отвечать на вопросы клиентов и генерировать контент для отдела продаж.

Узнайте, как ИИ может изменить ваши процессы с решениями от AI Lab. Будущее уже здесь!

«`